Karpathy의 LLM Wiki가 옳았다. 단지 로컬에서 실행하고 싶지 않았을 뿐이다.

(dev.to)

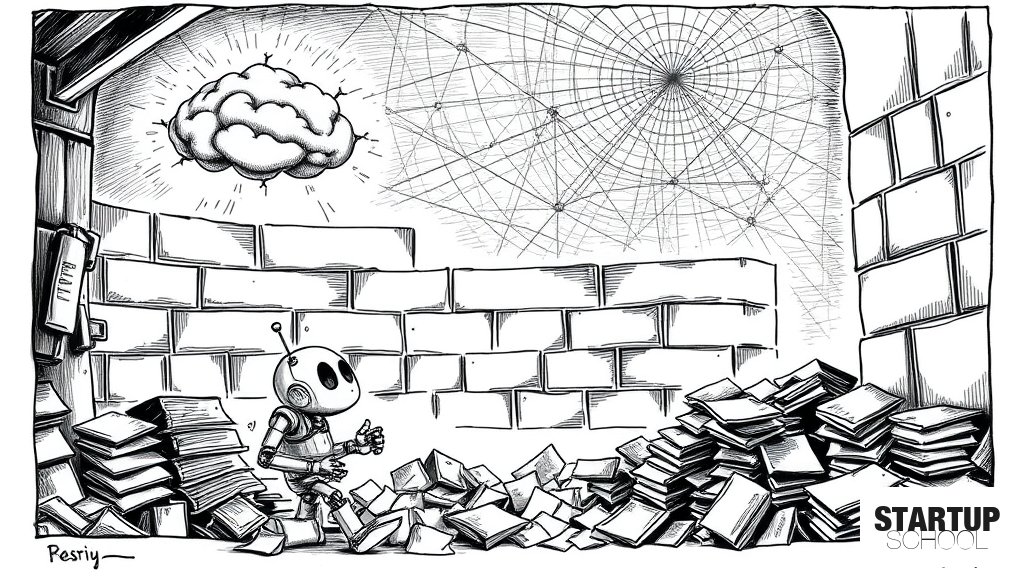

단순히 문서를 검색하는 RAG(검색 증강 생성)를 넘어, LLM 에이전트가 스스로 지식을 업데이트하고 관리하는 'LLM Wiki' 패턴의 가치를 조명합니다. 또한, 로컬 환경의 한계(동기화 및 접근성 문제)를 극복하기 위해 MCP(Model Context Protocol)를 활용하여 모든 LLM 클라이언트가 공유할 수 있는 클라우드 기반 지식 저장소인 'Hjarni'의 등장을 설명합니다.

이 글의 핵심 포인트

- 1RAG의 한계: 매번 지식을 새로 찾아야 하는 휘발성 구조

- 2LLM Wiki의 강점: 지식의 누적(Compounding)과 상호 참조를 통한 지식의 구조화

- 3