13시간 만에 6만 달러 청구: 유출된 Firebase 키가 AI 기반 앱을 망치는 이유

(dev.to)

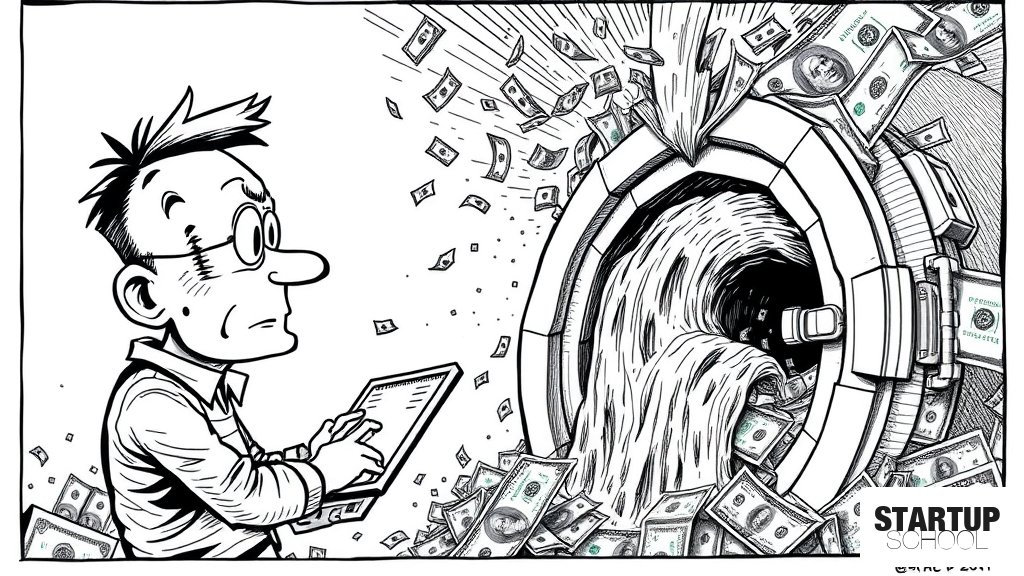

일본의 한 개발자가 Firebase와 Gemini API 키 유출로 인해 단 13시간 만에 약 6만 달러(약 8천만 원)의 비용을 청구받는 사고가 발생했습니다. 이는 AI가 생성한 코드가 기능 구현에만 집중하여 보안 설정을 간과할 수 있는 'AI 코딩 시대'의 치명적인 보안 취약점을 극명하게 보여줍니다.

- 1일본 개발자가 API 키 유출로 13시간 만에 약 6만 달러(900만 엔)의 비용 발생

- 2원인은 Google API 키에 대한 Application 및 API 제한(Restriction) 부재

- 3GitHub의 Firebase+AI 스타터 레포지토리 80%에서 보안 취약점 발견

- 4LLM(Claude, Copilot)은 보안 설정보다 기능 구현 위주의 코드를 생성하는 경향이 있음

- 5해결책: API 키의 백엔드 프록시 처리, API 키 접두사(AIza) 기반 스캐닝, 예산 알림 설정 필수

왜 중요한가

배경과 맥락

업계 영향

한국 시장 시사점

스타트업 창업자들에게 이번 사건은 '속도'와 '안전' 사이의 트레이드오프를 재고하게 만드는 강력한 메시지입니다. AI가 짜준 코드가 완벽하게 작동한다고 해서 그것이 안전하다는 뜻은 아닙니다. 특히 Next.js의 `NEXT_PUBLIC_`과 같이 브라우저에 노출되는 환경 변수를 무분별하게 사용하는 관행은 AI 시대에 가장 위험한 '보이지 않는 폭탄'입니다.

창업자는 개발 팀에게 단순히 '기능 구현'을 독려하는 것을 넘어, '보안이 포함된 완료(Definition of Done)'를 요구해야 합니다. Gemini나 OpenAI 같은 고비용 API를 사용하는 경우, 반드시 백엔드 프록시를 통해 키를 관리하고, Google Cloud Console에서 API 키의 사용 범위를 엄격히 제한하는 프로세스를 표준 개발 가이드라인으로 삼아야 합니다. 보안은 비용이 아니라, 비즈니스의 연속성을 보장하기 위한 필수적인 보험입니다.

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.