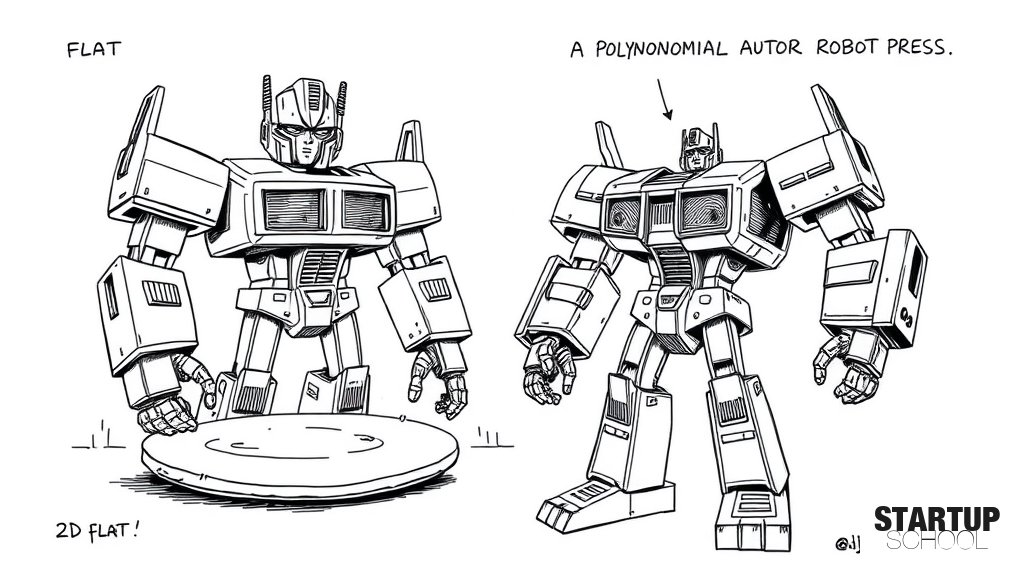

다항식 오토인코더, 트랜스포머 임베딩에서 PCA를 능가하다

(ivanpleshkov.dev)

트랜스포머 임베딩 압축 시 발생하는 성능 저하를 해결하기 위해, PCA의 선형적 한계를 극복한 '다항식 오토인코더(poly-AE)' 기술을 소개합니다. 이 방법은 별도의 딥러닝 학습(SGD) 없이 2차 다항식 디코더를 사용하여 압축된 벡터의 검색 성능(NDCG)을 원본 수준에 가깝게 복구합니다.

이 글의 핵심 포인트

- 1poly-AE는 PCA의 선형적 한계를 극복하여 2차 다항식 디코더로 비선형 정보를 복원함

- 2별도의 SGD나 에포크 학습 없이 closed-form 수식(Ridge OLS)만으로 구현 가능

- 3mxbai-embed-large-v1 모델 기준, 256d 압축 시 원본 대비 성능 저하를 0.85%p로 최소화

- 4PCA 대비 압축된 벡터의 검색 성능(NDCG@10)을 약 1~4.4%p 향상시킴

- 5약 150라인의 가벼운 Numpy 코드로 구현 가능하며 매우 빠른 연산 속도 제공

이 글에 대한 공공지능 분석

왜 중요한가

RAG(검색 증강 생성) 시스템의 확산으로 벡터 데이터베이스의 규모가 급증함에 따라, 임베딩 압축을 통한 비용 절감은 기업의 핵심 과제가 되었습니다. poly-AE는 압축률을 높이면서도 검색 정확도 손실을 최소화할 수 있는 매우 효율적인 수학적 대안을 제시합니다.

배경과 맥락

기존의 PCA(주성분 분석) 기반 압축은 선형 투영 방식이라 트랜스포머 임베딩 특유의 비선형적 구조(Cone effect)를 제대로 포착하지 못합니다. 본 기술은 PCA 인코더에 2차 다항식 디코더를 결합하여, 선형 모델이 놓치는 비선형적 정보(Nonlinear tail)를 복원합니다.

업계 영향

벡터 인덱스 용량을 4배 이상 줄이면서도 성능 저하를 극도로 낮출 수 있어, 대규모 벡터 검색 서비스의 인프라 비용(Memory/Storage)을 획기적으로 절감할 수 있습니다. 특히 별도의 학습 과정 없이 closed-form 수식만으로 계산 가능하여 적용 난이도가 매우 낮습니다.

한국 시장 시사점

대규모 한국어 임베딩 모델을 운영하며 높은 인프라 비용을 감당해야 하는 국내 AI 스타트업들에게 실질적인 비용 최적화(Cost Optimization) 솔루션을 제공합니다. 특히 데이터가 정적인 특성을 가진 검색 서비스라면 즉시 도입 가능한 기술적 돌파구가 될 수 있습니다.

이 글에 대한 큐레이터 의견

AI 스타트업 창업자 관점에서 이 기술은 '저비용 고효율'의 정석을 보여주는 사례입니다. 대부분의 딥러닝 기반 압축 기술은 추가적인 학습 비용과 복잡한 파이프라인을 요구하지만, poly-AE는 Ridge OLS라는 고전적이고 강력한 통계 기법을 활용해 '학습 없이(No SGD)' 성능을 끌어올렸습니다. 이는 엔지니어링 리소스를 최소화하면서도 서비스의 성능(NDCG)과 비용(Memory) 사이의 트레이드오프를 최적화할 수 있는 강력한 무기입니다.

다만, 주의할 점은 이 방식이 'Transductive' 방식, 즉 압축하려는 코퍼스(Corpus)의 통계량에 의존한다는 점입니다. 데이터가 실시간으로 급격하게 변하는 환경보다는, 주기적으로 인덱스를 업데이트하는 정적 또는 준정적(Semi-static) 검색 서비스에 훨씬 유리합니다. 따라서 기술 도입 시, 서비스의 데이터 업데이트 주기와 인프라 구조를 먼저 고려한 실행 전략이 필요합니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.