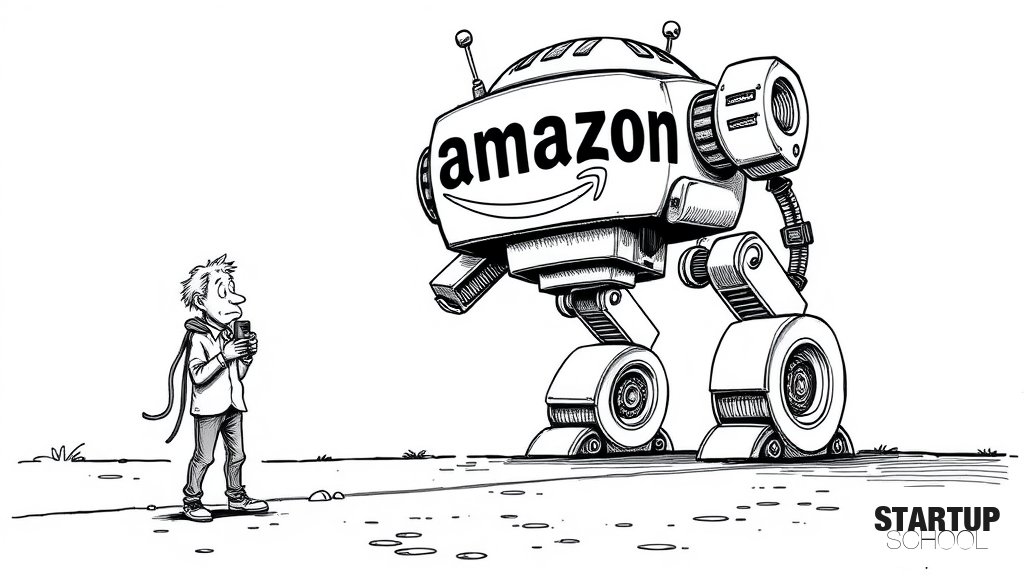

Amazonbot이 드디어 robots.txt를 준수하고 있다

(xeiaso.net)

Amazonbot이 2026년 6월 15일부터 robots.txt 표준 지침을 준수할 예정입니다. 이를 통해 웹사이트 운영자는 별도의 수동 요청 없이도 표준 프로토콜을 통해 Amazonbot의 사이트 접근 방식을 직접 제어할 수 있게 됩니다.

이 글의 핵심 포인트

- 12026년 6월 15일부터 Amazonbot의 robots.txt 준수 시작

- 2수동 요청 방식에서 표준 디렉티브를 통한 직접 제어로 전환

- 3페이지, 디렉토리, 사이트 단위의 세밀한 접근 제어 가능

- 4Amazonbot의 무분별한 스크래핑에 대응하기 위해 개발된 안티-스크래핑 도구(Anubis 등)의 역할 변화 예고

- 5표준 지침 미설정 시 일반적인 웹 크롤링 관행을 따름

이 글에 대한 공공지능 분석

왜 중요한가?

웹 크롤러에 대한 웹사이트 운영자의 통제권이 표준 프로토콜을 통해 자동화됩니다. 이는 데이터 주권을 확보하려는 개발자와 서비스 운영자들에게 매우 긍정적인 변화입니다.

어떤 배경과 맥락이 있나?

그동안 Amazonbot을 포함한 일부 대형 AI 크롤러들은 표준 지침을 무시하고 데이터를 수집하는 경향이 있었으며, 이에 대응하기 위해 Anubis와 같은 별도의 안티-스크래핑(Anti-scraping) 솔루션이 등장하는 배경이 되었습니다.

업계에 어떤 영향을 주나?

Amazonbot 전용 차단 도구에 대한 수요는 감소할 수 있으나, robots.txt를 활용한 정교한 크롤링 관리 및 데이터 거버넌스 전략이 더욱 중요해질 것입니다.

한국 시장에 어떤 시사점이 있나?

글로벌 빅테크의 데이터 수집에 노출된 국내 콘텐츠 및 데이터 스타트업들은 표준 프로토콜을 활용해 자사 데이터 자산을 보호하고, 크롤링 정책을 자동화할 수 있는 기술적 준비를 서둘러야 합니다.

이 글에 대한 큐레이터 의견

이번 발표는 AI 시대의 '데이터 주권' 싸움에서 웹 표준 프로토콜이 다시 힘을 얻는 중요한 변곡점입니다. 그동안 Amazonbot과 같은 거대 크롤러의 무분따른 수집에 대응하기 위해 개별적인 차단 기술을 개발했던 스타트업들에게는 비즈니스 모델의 재편이 필요한 시점입니다.

창업자들은 단순히 '차단'에 집중하기보다, '어떤 데이터를 허용하고 어떤 데이터를 보호할 것인가'에 대한 정교한 데이터 거버넌스 전략을 세워야 합니다. Amazonbot의 변화는 다른 AI 크롤러들에게도 확산될 수 있는 신호탄이 될 수 있으므로, robots.txt를 포함한 표준 규격에 맞춘 데이터 관리 자동화 시스템 구축을 핵심적인 실행 과제로 삼아야 합니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.