과장된 기대 너머: 실용적인 AI 기반 코드 쿼리 엔진 구축

(dev.to)

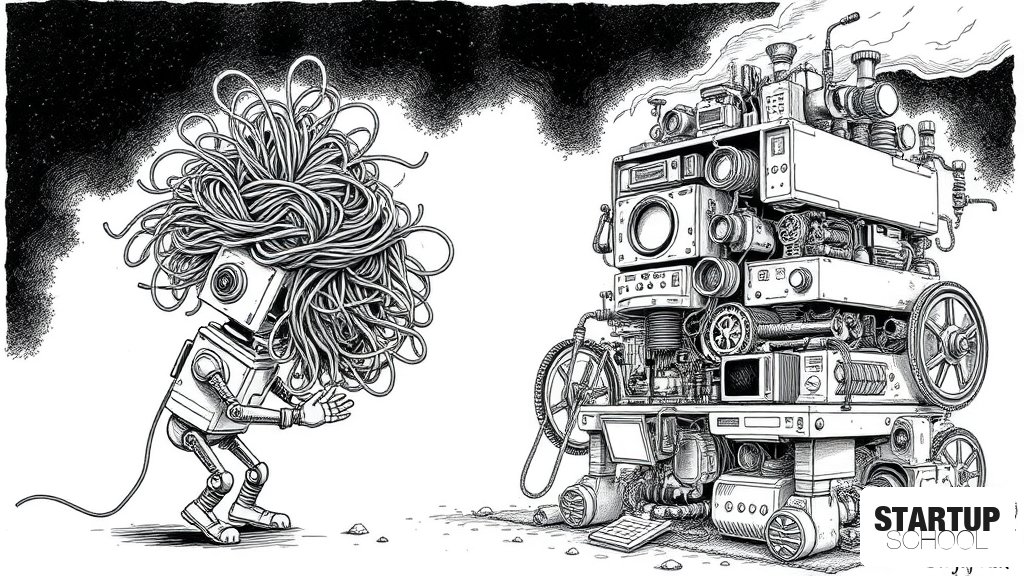

이 기사는 단순한 LLM 호출을 넘어, 대규모 코드베이스를 효율적으로 이해할 수 있는 'AI 코드 쿼리 엔진'의 실무적인 구축 방법을 다룹니다. RAG(Retrieval-Augmented Generation) 패턴을 기반으로 코드 파싱(AST), 시맨틱 검색(Embedding), 그리고 로컬 LLM(Ollama)을 결합한 3계층 아키텍처를 상세히 설명합니다.

이 글의 핵심 포인트

- 1RAG(Retrieval-Augmented Generation) 패턴을 통한 대규모 코드베이스 컨텍스트 문제 해결

- 2AST(Abstract Syntax Tree)를 활용하여 함수/클래스 단위의 논리적 코드 청킹 구현

- 3