주말에 AI 코딩 도구용 컨텍스트 방화벽 구축: 이유와 방법

(dev.to)

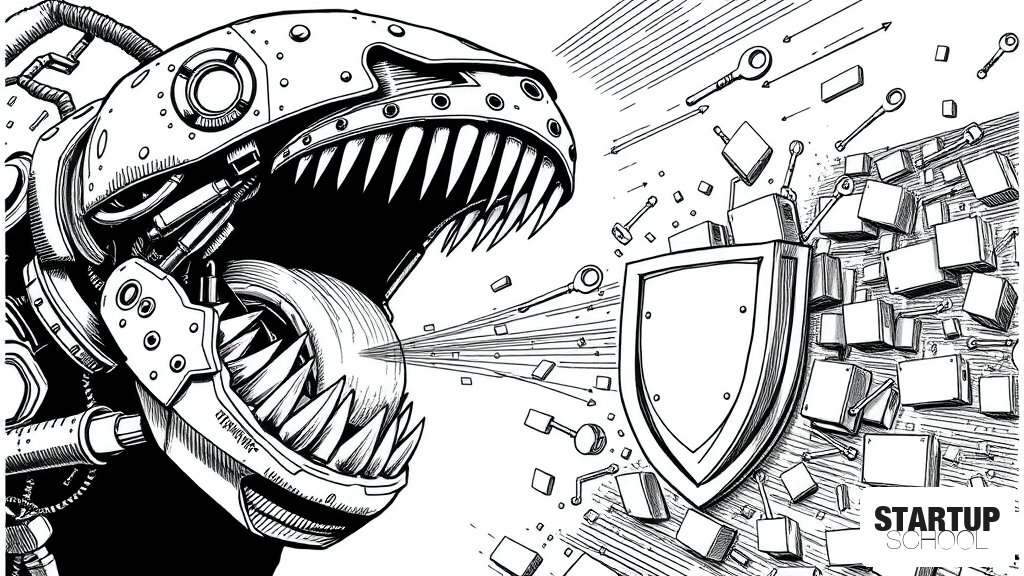

AI 코딩 도구(Cursor, Claude Code 등) 사용 시 발생할 수 있는 API 키, 개인정보 등 민감 데이터 유출을 방지하기 위한 로컬 기반 컨텍스트 방화벽 'ContextDuty'를 소개합니다. 이 도구는 MCP(Model Context Protocol) 서버로 동작하여, AI 어시스턴트에 데이터가 전달되기 전 자동으로 민감 정보를 탐지하고 마스킹합니다.

이 글의 핵심 포인트

- 1AI 코딩 도구 사용 시 API 키, 이메일, AWS 자격 증명 등 민감 정보 유출 위험 상존

- 2ContextDuty는 로컬 기반 컨텍스트 방화벽으로, 데이터 전송 전 자동 마스킹 기능 제공

- 3MCP(Model Context Protocol) 서버로 동작하여 Cursor, VS Code 등과 자동 연동 가능

- 4현재 PyPI에 출시되었으며, 이메일, API 키, 전화번호 등 초기 단계의 탐지 기능 구현

- 5개발자 워크플로우를 방해하지 않는 '로컬 우선(Local-first)' 보안 접근 방식 채택

이 글에 대한 공공지능 분석

왜 중요한가

AI 코딩 어시스턴트의 확산과 함께 개발자가 무심코 입력한 로그나 코드 내의 자격 증명(Credentials)이 외부 LLM으로 유출되는 보안 사고 위험이 급증하고 있습니다. ContextDuty는 이러한 보안 허점을 개발자의 워크플로우를 방해하지 않으면서 해결하려는 시도라는 점에서 매우 중요합니다.

배경과 맥락

최근 Cursor나 Claude Code와 같은 AI 에이전트 기반 코딩 도구가 대중화되면서, 프롬프트에 포함되는 컨텍스트의 양과 질이 중요해졌습니다. 이 과정에서 데이터 프라이버시와 보안(Data Leakage) 문제가 핵심 쟁점으로 떠올랐으며, 이를 해결하기 위해 MCP와 같은 새로운 표준을 활용한 보안 레이어 구축이 논의되고 있습니다.

업계 영향

이러한 'AI 보안(AI Security)' 도구의 등장은 AI 에이전트 생태계에서 '신뢰 레이어(Trust Layer)'의 필요성을 증명합니다. 향후 개발 도구 시장은 단순한 기능 제공을 넘어, 기업의 보안 정책을 자동화된 방식으로 준수할 수 있게 돕는 '보안 내재화(Security by Design)' 솔루션 중심으로 재편될 가능성이 높습니다.

한국 시장 시사점

개인정보보호법 등 규제가 엄격한 한국 기업 환경에서 AI 코딩 도구 도입의 가장 큰 장애물은 데이터 유출 우려입니다. 개발자의 생산성을 유지하면서도 기업의 보안 가이드라인을 강제할 수 있는 '로컬 우선(Local-first)' 보안 솔루션은 국내 엔터프라이즈 시장의 AI 도입을 가속화할 핵심 기술이 될 수 있습니다.

이 글에 대한 큐레이터 의견

AI 코딩 도구의 폭발적 성장 뒤에는 '데이터 유출'이라는 거대한 보안 부채가 숨어 있습니다. ContextDuty와 같은 프로젝트는 단순한 보안 유틸리티를 넘어, AI 에이전트 시대의 '신뢰 레이어(Trust Layer)'를 구축하는 비즈니스 기회를 보여줍니다. 창업자들은 개발자의 생산성을 저해하지 않으면서도 기업의 보안 정책을 투명하게 적용할 수 있는 'Zero-friction' 보안 기술에 주목해야 합니다.

특히 MCP(Model Context Protocol)를 활용하여 별도의 수동 작업 없이 AI 어시스턴트에 자동 적용되는 방식은 매우 영리한 접근입니다. 만약 이 분야의 스타트업을 구상 중이라면, 단순한 패턴 매칭 탐지를 넘어 기업별 맞춤형 보안 정책(Policy Layering)을 자동화하고, 유출 시나리오를 시뮬레이션할 수 있는 엔터프라이즈급 관리 기능을 결합하여 차별화된 가치를 창출할 수 있을 것입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.