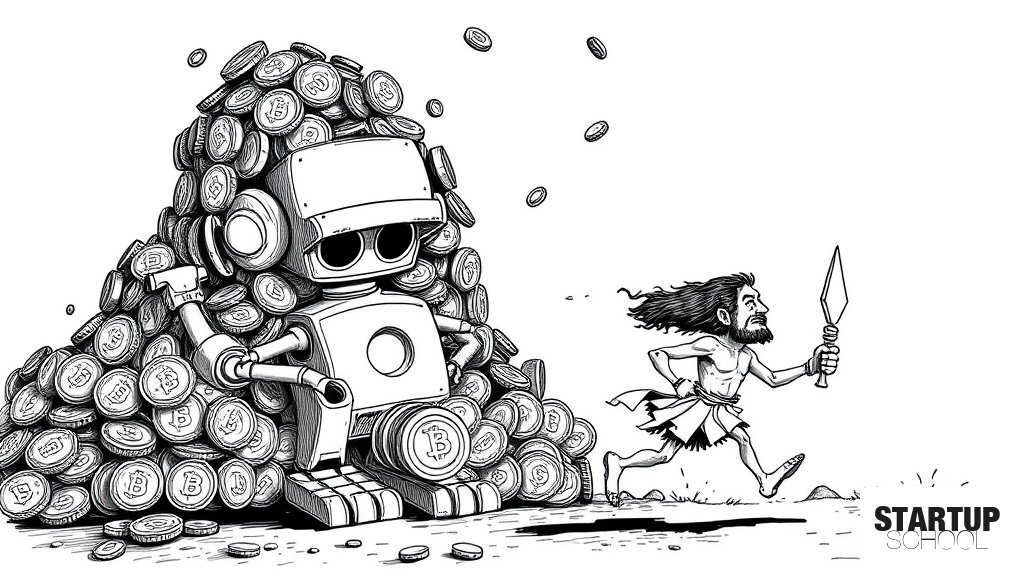

원시인: 적은 token으로도 충분한데, 왜 많은 token을 쓰는가?

(github.com)

'케이브맨(Caveman)' 플러그인은 LLM(특히 Claude)의 출력 토큰 사용량을 평균 65%(최대 87%) 획기적으로 절감하면서도 기술적 정확도를 100% 유지합니다. 간결한 '원시인 말투'를 사용하여 응답 속도를 3배 높이고 가독성을 개선하며, 간결함이 LLM 성능을 향상시킨다는 연구 결과에 기반합니다.

이 글의 핵심 포인트

- 1'케이브맨' 플러그인은 LLM 출력 토큰 사용량을 평균 65%, 최대 87%까지 절감하여 비용 효율성을 극대화합니다.

- 2기술적 정확도를 100% 유지하면서도, 응답 속도를 약 3배 향상시키고 간결한 표현으로 가독성을 높입니다.

- 3