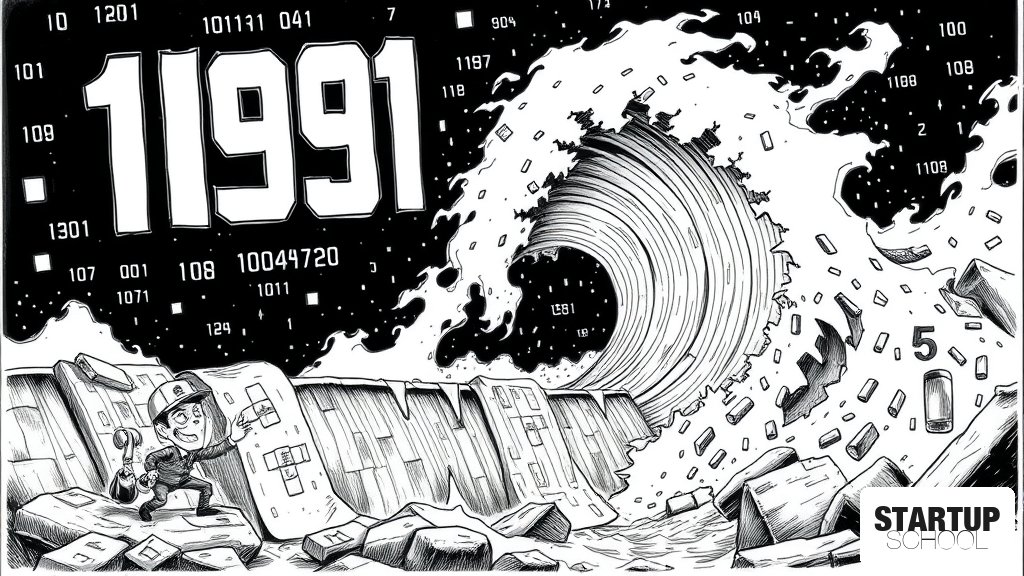

심층 분석: 오류 허용 Metrics 저장소 구축하기

(dev.to)

Airbnb가 초당 5,000만 개의 샘플을 처리할 수 있는 고가용성 메트릭 저장소 아키텍처를 구축한 사례를 분석합니다. 분산 데이터베이스와 실시간 처리 프레임워크를 활용해 데이터 손실 없이 대규모 트래픽을 견디는 기술적 메커니즘과 그 비즈니스적 가치를 다룹니다.

이 글의 핵심 포인트

- 1초당 5,000만 개의 샘플을 처리할 수 있는 대규모 데이터 처리 능력 확보

- 2분산 데이터베이스와 실시간 프레임워크를 결합한 아키텍처 활용

- 3샤딩(Sharding) 및 복제(Replication)를 통한 데이터 일관성 및 가용성 확보

- 4데이터 손실 방지 및 장애 복구 속도 향상을 통한 운영 비용 절감

- 5이커머스 및 금융 등 대규모 트래픽이 발생하는 산업군에 적용 가능한 모델

이 글에 대한 공공지능 분석

왜 중요한가?

초당 5,000만 개라는 방대한 데이터를 유실 없이 처리할 수 있는 기술적 신뢰성을 확보했다는 점이 핵심입니다. 이는 단순한 데이터 저장을 넘어, 시스템 장애 시에도 비즈니스 연속성을 보장하는 인프라 설계의 중요성을 시사합니다.

어떤 배경과 맥락이 있나?

현대 대규모 플랫폼은 실시간 모니터링과 데이터 기반 의사결정이 필수적입니다. 이를 위해 샤딩(Sharding)과 복제(Replication)를 활용한 분산 아키텍처 설계가 데이터 엔지니어링의 핵심 과제로 부상하고 있습니다.

업계에 어떤 영향을 주나?

이 모델은 이커머스, 핀테크 등 대규모 트래픽을 다루는 산업 전반에 표준적인 아키텍처 가이드를 제공합니다. 안정적인 데이터 파이프라인 구축은 운영 비용 절감과 고객 신뢰도 향상으로 직결됩니다.

한국 시장에 어떤 시사점이 있나?

글로벌 확장을 목표로 하는 한국의 유니콘 및 성장기 스타트업들에게 데이터 가용성 설계는 필수적입니다. 초기 단계부터 확장 가능한(Scalable) 데이터 아키텍처를 고려하는 설계 역량이 향후 기술적 경쟁력이 될 것입니다.

이 글에 대한 큐레이터 의견

스타트업 창업자 관점에서 Airbnb의 사례는 '기술적 부채'와 '확장성' 사이의 균형을 어떻게 잡아야 하는지를 보여줍니다. 초당 5,000만 개의 샘플을 처리하는 시스템은 엄청난 비용과 복잡도를 수반합니다. 모든 스타트업이 처음부터 이 정도의 아키텍처를 구축할 필요는 없지만, 데이터의 유실이 비즈니스 치명타로 이어지는 도메인(금융, 결제, 물류 등)이라면 '오류 허용(Fault-tolerance)' 설계는 선택이 아닌 필수입니다.

기회 측면에서는, 이러한 분산 처리 기술을 내재화하거나 적절한 Managed Service를 활용해 데이터 신뢰성을 확보함으로써 서비스의 안정성을 차별화 포인트로 삼을 수 있습니다. 반면, 위협 요소는 과도한 인프라 복잡성으로 인한 운영 비용 상승입니다. 따라서 현재의 비즈니스 규모에 맞는 '적정 기술'을 선택하되, 데이터의 무결성이 깨지지 않는 구조적 기반을 마련하는 전략적 접근이 필요합니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.