Go로 구축한 프록시: 클라우드 할당량이 소진되어도 LLM 대화를 유지하는 방법

(dev.to)

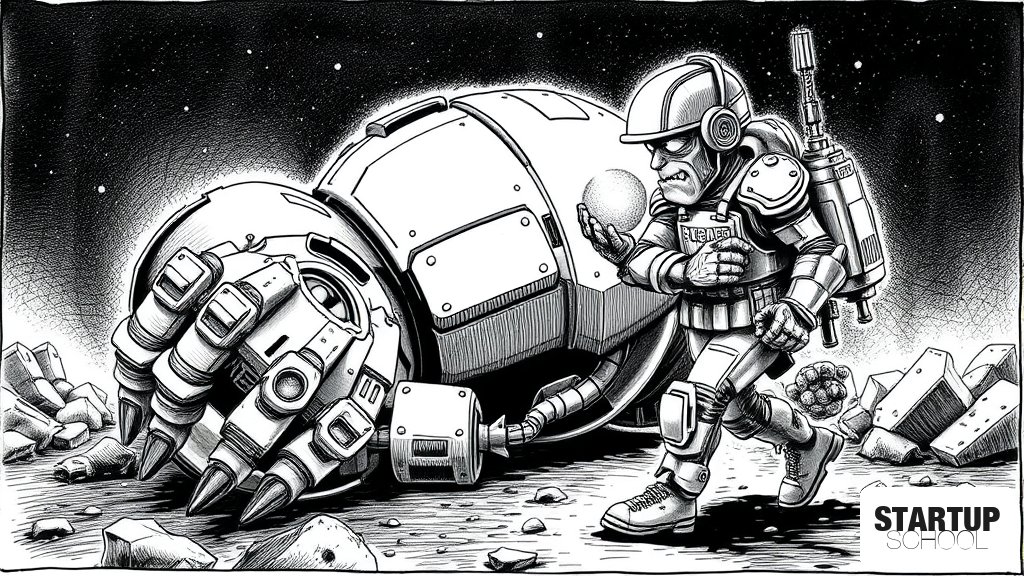

클라우드 LLM(Claude, GPT 등)의 사용량 제한(Quota Limit) 발생 시, 대화 맥락을 유지하며 로컬 Ollama 모델로 자동 전환해주는 Go 기반 프록시 'Trooper'를 소개합니다. 단순한 모델 전환을 넘어, '3단계 컨텍스트 압축(Anchor, SITREP, Tail)' 전략을 통해 로컬 모델에서도 이전 대화의 흐름을 끊김 없이 이어갈 수 있도록 설계되었습니다.

이 글의 핵심 포인트

- 1클라우드 LLM(Claude, Gemini, OpenAI)의 쿼타 제한 발생 시 Ollama로 자동 폴백(Fallback) 지원

- 23단계 컨텍스트 압축 전략(Anchor, SITREP, Tail)을 통한 대화 맥락 유지 기술 적용

- 3Go 언어로 작성되어 의존성 없는 단일 바이너리 실행 및 높은 보안 감사 가능성 제공

- 4중간 대화 내용을 SITREP(의도, 엔티티, 진행 상황 등)로 구조화하여 로컬 모델의 인지 능력 극대화

- 5약 850라인의 가벼운 코드베이스로 유지보수 및 확장이 용이한 구조

이 글에 대한 공공지능 분석

왜 중요한가

배경과 맥락

업계 영향

한국 시장 시사점

이 글에 대한 큐레이터 의견

스타트업 창업자 관점에서 Trooper의 접근 방식은 '비용 효율적 회복 탄력성(Cost-effective Resilience)'의 정석을 보여줍니다. 대부분의 기업이 API 비용 절감을 위해 모델 경량화나 로컬 전환을 고민하지만, 전환 과정에서의 정보 손실(Context Loss) 때문에 이를 포기하곤 합니다. Trooper는 'SITREP(상황 보고)'라는 구조화된 요약 방식을 통해 로컬 모델의 한계를 기술적으로 우회하며, 이는 서비스 운영 비용(OPEX)을 획기적으로 낮출 수 있는 기회입니다.

개발자들에게는 '단일 바이너리'와 '낮은 의존성'을 강조한 Go 언어의 선택이 매우 영리한 전략으로 보입니다. 보안이 중요한 API 키 관리 환경에서 코드가 짧고 명확하다는 것은 감사(Audit) 용이성을 높여 신뢰도를 확보하는 핵심 요소입니다. 향후 AI 에이전트 개발 시, 단순히 모델을 교체하는 것을 넘어 '어떻게 맥락을 압축하여 전달할 것인가'에 대한 구조적 설계(Architecture)가 서비스의 품질을 결정짓는 차별화 포인트가 될 것입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.