LLM용 TurboQuant 작동 방식과 RAM 사용량이 훨씬 적은 이유

(dev.to)

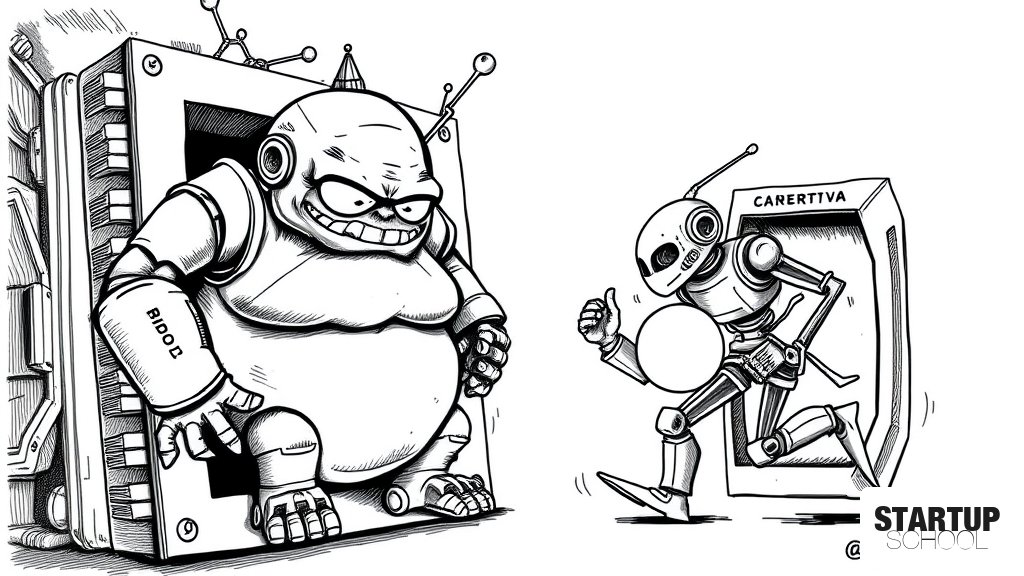

LLM 스케일링의 주요 병목이 모델 크기/GPU에서 메모리 효율성으로 전환되며, 특히 추론 시 KV 캐시가 막대한 RAM을 소비합니다. TurboQuant는 숫자를 스케일과 정수 코드로 저장하고 어텐션 정확도를 유지하는 경량 교정 단계를 통해 기존 양자화보다 훨씬 적은 RAM으로 LLM을 효율적으로 운영하는 방법을 제시합니다. 이는 LLM 서비스의 비용과 속도 문제를 해결하는 핵심 기술입니다.

이 글의 핵심 포인트

- 1LLM 스케일링의 핵심 병목은 GPU/모델 크기에서 *메모리 효율성*으로 전환되고 있습니다.

- 2LLM은 각 토큰을 약 4096개의 숫자로 이루어진 벡터로 저장하며, 각 레이어에서 K/V 벡터를 생성하여 *KV 캐시*에 저장합니다.

- 3