LLM 앱의 데이터 유출을 막기 위해 오픈 소스 AI 방화벽을 구축했습니다.

(dev.to)

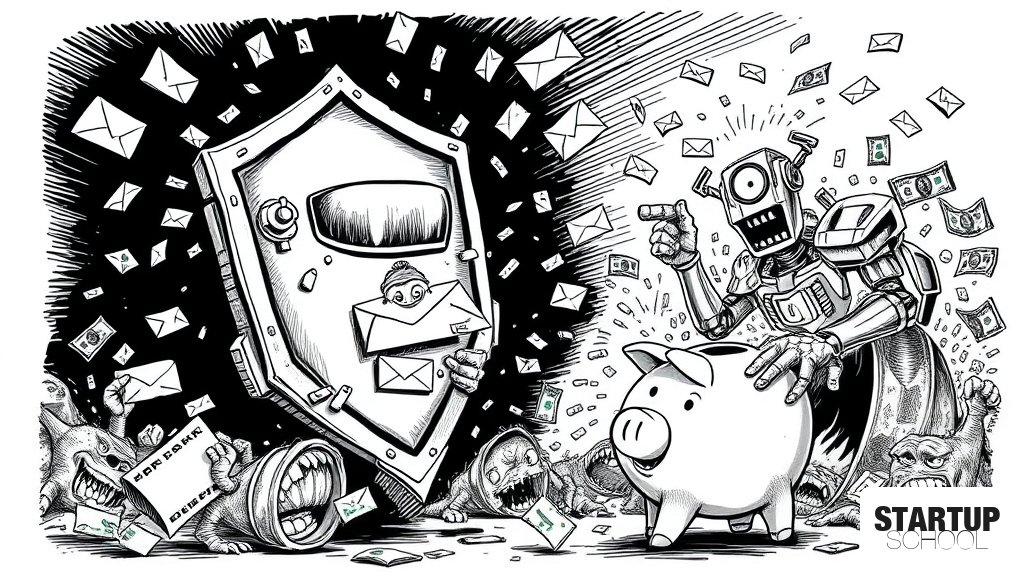

LLM 애플리케이션의 고질적인 문제인 개인정보 유출과 API 비용 폭증을 해결하기 위해 개발된 오픈 소스 AI 보안 게이트 모델(AISG)을 소개합니다. 이 프록시는 PII(개인정보) 마스킹, 프롬프트 인젝션 방지, 예산 제한 및 비용 최적화 라우팅 기능을 통해 안전하고 경제적인 AI 서비스 운영을 지원합니다.

이 글의 핵심 포인트

- 128종 이상의 PII(개인정보) 유형 및 이미지 내 텍스트(OCR) 실시간 탐지 및 마스킹

- 2프롬프트 인젝션, 탈옥(Jailbreak) 및 명령 탈취 공격 방지 기능

- 3API 사용량 한도 도달 시 즉시 차단하는 하드 스탑(Hard Stop) 예산 관리 기능

- 4600개 이상의 모델과 8개 이상의 제공업체를 비교하여 비용을 30~60% 절감하는 스마트 라우팅

- 5데이터를 저장하지 않는 Stateless 아키텍처로 GDPR, HIPAA 등 글로벌 컴플라이언스 준수 용이

이 글에 대한 공공지능 분석

왜 중요한가

LLM 도입이 가속화됨에 따라 사용자 입력 데이터가 외부 API로 전송되는 과정에서의 보안 취약점과 에이전트 루프로 인한 비용 통제 불능 문제가 기업의 핵심 리스크로 부상했기 때문입니다. 이 도구는 개발자가 기존 코드를 거의 수정하지 않고도 즉시 적용 가능한 실질적인 해결책을 제시합니다.

배경과 맥락

기업들이 LLM을 서비스에 통합할 때, 개발자나 PM이 데이터 보안 및 컴플라이언스(GDPR, HIPAA 등)를 미처 고려하지 못하는 경우가 많습니다. 또한, 자율적으로 동작하는 AI 에이전트가 예기치 않게 막대한 API 비용을 발생시키는 사례가 늘어나면서, 이를 중간에서 제어할 수 있는 'AI 보안 레이어'의 필요성이 커지고 있습니다.

업계 영향

AI 보안(AI Security)이 소프트웨어 스택의 필수적인 인프라 레이어로 자리 잡을 것임을 시사합니다. 단순한 모델 호출을 넘어, 데이터 마스킹과 비용 관리가 포함된 '거버로스(Governance) 프록시'가 엔터프라이즈 AI 솔루션의 표준 구성 요소가 될 가능성이 높습니다.

한국 시장 시사점

개인정보보호법(PII) 규제가 매우 엄격한 한국 시장에서, LLM 서비스를 개발하는 스타트업들에게는 데이터 유출 리스크를 방어할 수 있는 강력한 기술적 방어선이 될 수 있습니다. 또한, 글로벌 모델 사용 시 발생하는 높은 비용을 최적화하기 위한 전략적 도구로 활용 가치가 매우 높습니다.

이 글에 대한 큐레이터 의견

AI 스타트업 창업자들에게 이 기술은 '비용 절감'과 '신뢰 구축'이라는 두 마리 토끼를 잡을 수 있는 중요한 기회를 제공합니다. 특히 'Smart Cost Routing'을 통해 모델 비용을 30~60%까지 절감할 수 있다는 점은 마진율 확보가 절실한 초기 스타트업에게 매우 매력적인 인사이트입니다. 또한, 보안 프록시를 활용함으로써 보안 인프라 구축에 드는 엔지니어링 리소스를 최소화하면서도 엔터프라이즈급 보안 수준을 확보할 수 있습니다.

하지만 동시에 이는 AI 서비스의 '안전성'이 더 이상 선택이 아닌 생존의 문제임을 경고합니다. 이제 고객과 투자자는 단순히 'AI 기능이 있다'는 것만으로 만족하지 않으며, 데이터 유출을 어떻게 막고 비용 폭증을 어떻게 통제하는지에 대한 구체적인 아키텍처를 요구할 것입니다. 따라서 개발 초기 단계부터 'Security-by-design' 원칙을 적용하여, 보안과 비용 관리가 내재화된 AI 제품을 설계하는 역량이 핵심 경쟁력이 될 것입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.