Kubernetes 1.36: 컨테이너 레벨 리소스 제약에서 벗어나다

(dev.to)

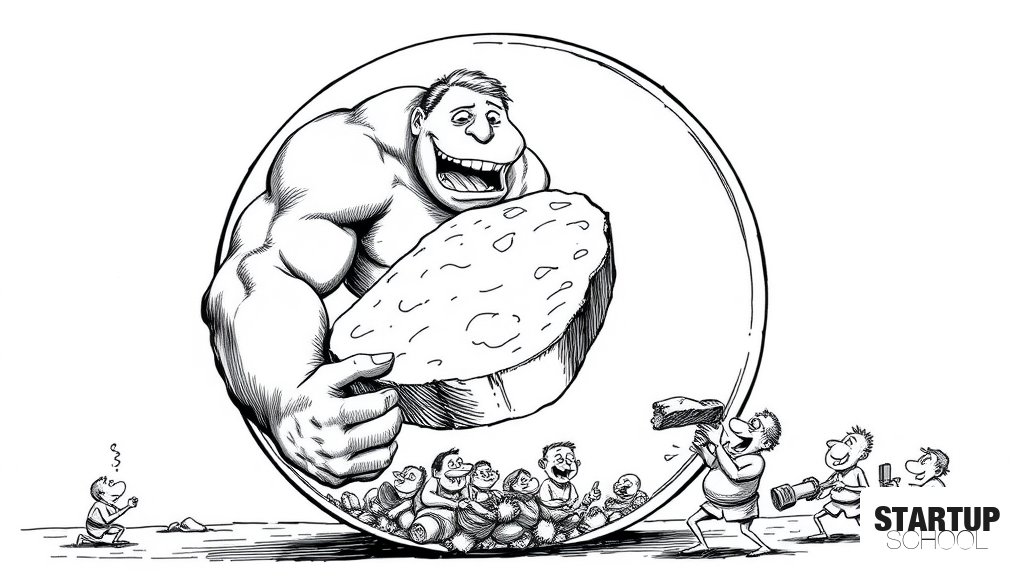

쿠버네티스 1.36에서 도입된 'Pod-Level Resource Managers(Alpha)'는 컨테이너 단위가 아닌 포드 단위로 리소스를 관리하여, 핵심 워크로드에는 전용 리소스를, 사이드카에는 공유 리소스를 할당할 수 있게 합니다. 이를 통해 고성능 워크로드의 성능 보장과 사이드카로 인한 리소스 낭비 문제를 동시에 해결할 수 있습니다.

이 글의 핵심 포인트

- 1Kubernetes 1.36에서 Pod-Level Resource Managers 기능이 Alpha로 도입됨

- 2메인 컨테이너에는 전용(Exclusive) CPU/Memory를, 사이드카에는 공유(Shared) 리소스를 할당하는 하이브리드 모델 가능

- 3NUMA 정렬 및 CPU 격리가 필요한 ML, DB, HFT 워크로드의 성능 최적화에 특화

- 4기존 컨테이너 단위의 엄격한 리소스 할당 방식에서 포드 단위의 의도적(Intent-based) 할당 방식으로 전환

- 5현재 Alpha 단계이므로 프로덕션 적용은 지양하되, 개발 환경에서의 사전 테스트 및 피드백 권장

이 글에 대한 공공지능 분석

왜 중요한가

기존 쿠버네티스는 모든 컨테이너에 동일한 리소스 제약을 적용해야 했기에, 성능이 중요한 메인 컨테이너와 가벼운 사이드카(로그 수집기, 프록시 등) 사이의 리소스 불균형을 해결하기 어려웠습니다. 이번 업데이트는 '전용 리소스 할당'과 '리소스 효율성'이라는 두 마리 토끼를 잡을 수 있는 기술적 돌파구를 제공합니다.

배경과 맥락

서비스 메쉬(Istio 등)와 관측성(Prometheus 등) 도구의 보편화로 인해 하나의 포드 내에 여러 사이드카 컨테이너가 실행되는 것이 표준이 되었습니다. 하지만 기존의 컨테이너별 리소스 관리 모델은 사이드카에도 메인 컨테이너와 동일한 수준의 엄격한 리소스 격리 로직을 적용하게 만들어, 불필요한 CPU/메모리 점유와 비용 상승을 초래해 왔습니다.

업계 영향

ML 트레이닝, 고빈도 매매(HFT), 대규모 데이터베이스 운영과 같이 NUMA 정렬 및 CPU 격리가 필수적인 분야에서 인프라 운영 효율성이 극대화될 것입니다. 이는 클라우드 네이티브 환경에서 '워크로드 인지형(Workload-aware)' 리소스 관리 시대로의 전환을 의미합니다.

한국 시장 시사점

클라우드 비용 최적화(FinOps)가 생존 전략인 한국의 AI 스타트업과 핀테크 기업들에게 매우 중요한 소식입니다. GPU 및 고성능 CPU 인스턴스 사용 비중이 높은 기업들은 향후 이 기능을 통해 사이드카 오버헤드를 줄임으로써 인프라 단위당 처리량(Throughput)을 높이고 비용 구조를 개선할 수 있습니다.

이 글에 대한 큐레이터 의견

이번 쿠버네티스 1.36의 기능 업데이트는 단순한 기능 추가를 넘어, 인프라 아키텍처의 패러다임이 '컨테이너 중심'에서 '워크로드 중심'으로 진화하고 있음을 보여줍니다. 스타트업 창업자 관점에서 이는 '사이드카 세금(Sidecar Tax)'이라 불리는 숨겨진 인프라 비용을 절감할 수 있는 강력한 레버리지가 될 것입니다.

특히 AI 모델 서빙이나 대규모 트래픽을 처리하는 플랫폼을 운영하는 팀이라면, 지금 당장 프로덕션에 적용할 수는 없더라도(Alpha 단계이므로), 개발 환경에서 이 기능을 테스트하며 자사 워크로드의 리소스 프로파일링을 재점검해야 합니다. 메인 컨테이너의 성능은 유지하면서 사이드카의 리소스를 얼마나 탄력적으로(Burstable) 가져갈 수 있는지 실험하는 것이 향후 클라우드 비용 경쟁력을 결정짓는 핵심 요소가 될 것입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.