Postgres에서 JSON 컬럼에서 정식 스키마로 마이그레이션하기

(dev.to)

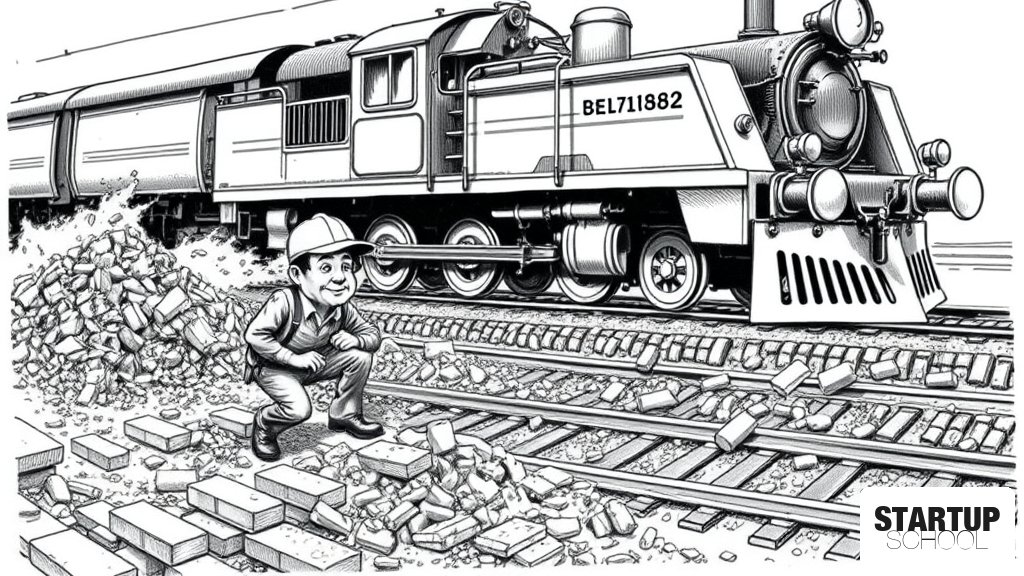

PostgreSQL의 JSONB 컬럼에 저장된 데이터를 서비스 중단 없이 정식 스키마 컬럼으로 전환하는 'Expand-and-Contract' 패턴을 설명합니다. 대규모 테이블에서 락(Lock) 문제를 피하기 위해 컬럼을 Nullable로 추가하고, 배치 단위 백필과 애플리케이션 이중 쓰기를 통해 데이터 정합성을 유지하며 안전하게 마이그레이션하는 구체적인 방법론을 제시합니다.

이 글의 핵심 포인트

- 1JSONB 컬럼의 인덱스 부서로 인한 800ms의 쿼리 지연 문제를 해결하기 위한 스키마 전환 전략

- 2대규모 테이블의 락(Lock) 방지를 위해 컬럼을 Nullable로 먼저 추가하는 'Metadata-only' 방식 활용

- 3FOR UPDATE SKIP LOCKED를 사용한 배치 단위 백필로 복제 지연(Replication Lag) 및 서비스 영향 최소화

- 4애플리케이션 레벨의 이중 쓰기(Dual-write)를 통해 신규 데이터와 기존 데이터 간의 정합성 유지

- 5데이터 타입 불일치(예: 숫자가 들어갈 자리에 'n/a'가 있는 경우)를 사전에 식별하고 처리하는 방어적 접근

이 글에 대한 공공지능 분석

왜 중요한가

배경과 맥락

업계 영향

한국 시장 시사점

이 글에 대한 큐레이터 의견

이 기사는 단순한 기술 튜토리얼을 넘어, '기술 부채를 어떻게 관리할 것인가'에 대한 엔지니어링 철학을 담고 있습니다. 많은 창업자가 빠른 출시를 위해 JSONB와 같은 유연한 구조를 선택하지만, 그 대가로 찾아오는 성능 저하와 데이터 오염은 결국 서비스의 생존을 위협하는 리스크가 됩니다. 핵심은 '어떻게 바꾸느냐'가 아니라, '어떻게 서비스 중단 없이 안전하게 바꾸느냐'에 있습니다.

창업자와 리더들은 개발팀이 이러한 'Expand-and-Contract' 패턴을 적용할 수 있는 환경(배치 작업, 모니터링, 안전한 배포 프로세스)을 구축하도록 지원해야 합니다. 특히 기사에서 언급된 '잘못된 데이터(bad data)를 사전에 식별하는 과정'은 매우 날카로운 통찰입니다. 마이그레이션 실패의 원인은 대개 새로운 로직이 아니라, 과거에 무심코 쌓아둔 오염된 데이터에 있기 때문입니다. 따라서 기술적 전환기에는 코드 수정만큼이나 데이터 정제(Data Cleansing)에 대한 리소스를 확보하는 것이 실행 가능한 핵심 전략입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.