전문가 혼합

(dev.to)

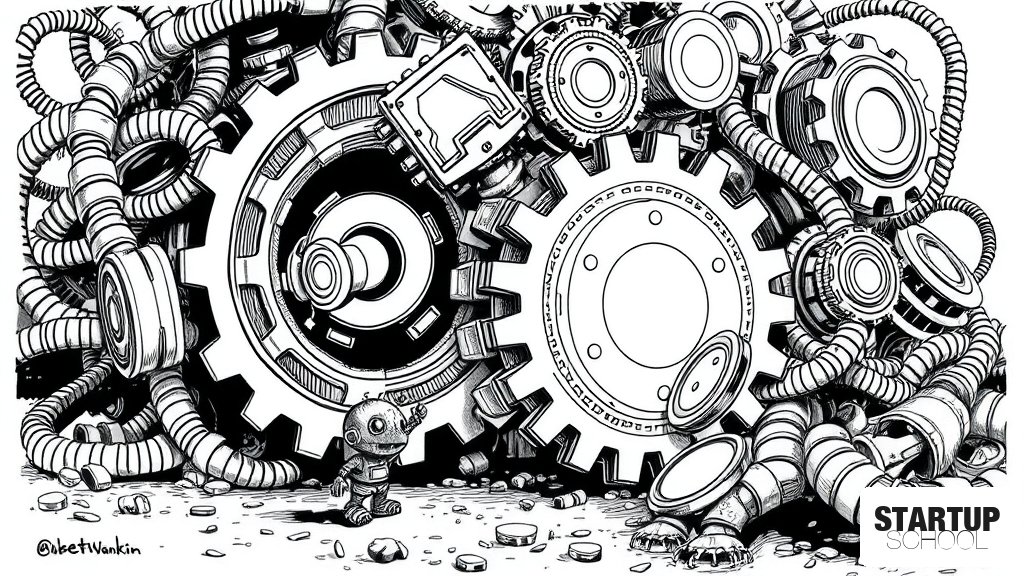

Mixture of Experts (MoE) 아키텍처는 LLM의 컴퓨팅 비용을 절감하는 잠재력을 가졌지만, 토큰 레벨 라우팅, 전문가 붕괴 방지, 막대한 VRAM 요구사항, 네트워크 통신 병목 등 복잡한 엔지니어링 과제를 수반합니다. 이는 인퍼런스 시 컴퓨팅에만 한정된 비용 절감이며, 전체 모델이 항상 메모리에 로드되어야 하므로 소규모 팀에는 큰 부담이 됩니다. 따라서 MoE는 단순한 해결책이 아니라 고도의 기술력과 자원을 요구하는 복잡한 트레이드오프의 게임입니다.

이 글의 핵심 포인트

- 1MoE는 밀집 모델의 하드웨어 장벽을 해결하여 인퍼런스 시 컴퓨팅 비용을 절감하지만, '7B 모델 가격으로 100B 모델 품질'을 제공하는 마법은 아니다.

- 2라우팅은 프롬프트 레벨이 아닌 토큰 레벨에서 작동하며, Top-2 라우팅은 고품질을 제공하나 높은 GPU 클러스터 통신 오버헤드를 유발한다.

- 3