RAM 부족, 더 큰 문제 (2025)

(fabiensanglard.net)

이 글의 핵심 포인트

- 1RAM 용량 증설이 Quake 게임 프레임을 44fps에서 33fps로 약 25% 하락시킴

- 2Intel 430FX 칩셋의 캐시 지원 한계(64MB) 초과 시 성능 저하 발생

- 3메모리 증설 시 운영체제와 소프트웨어가 캐시되지 않는 영역(Non-cached region)에 로드됨

- 4하드웨어 자원의 확장이 반드시 성능 향상으로 이어지지 않는 '자원 역설' 사례

- 5인프라 설계 시 하드웨어/소프트웨어 계층의 구조적 제약 사항 파악의 중요성

이 글에 대한 공공지능 분석

왜 중요한가

자원 확장이 성능 최적화의 정답이 아닐 수 있다는 역설적인 통찰을 제공합니다. 인프라의 병목 지점을 정확히 파악하는 것이 단순한 자원 투입보다 훨씬 중요하다는 점을 시사합니다.

배경과 맥락

1990년대 후반 Intel 430FX 칩셋과 같은 하드웨어 제약 사항을 다룹니다. 당시 메모리 용량 증설이 칩셋의 캐시 지원 범위를 벗어나게 만들어, L2 캐시의 이점을 상실하고 프레임 레이트를 25%나 떨어뜨렸던 기술적 배경을 설명합니다.

업계 영향

클라우드 컴퓨팅 및 대규모 분락 시스템 환경에서도 인스턴스 사양(CPU/RAM)을 높이는 것이 반드시 처리량(Throughput) 증가로 이어지지 않을 수 있음을 경고합니다. 이는 아키텍처 설계 시 자원 할당의 임계점(Threshold)을 고려해야 함을 의미합니다.

한국 시장 시사점

한국의 많은 스타트업이 클라우드 비용 절감을 위해 인스턴스 크기 조정에 집중하지만, 데이터베이스나 캐시 계층의 구조적 한계를 간과할 위험이 있습니다. 비용 효율적인 스케일링 전략을 위해 인프라 모니터링과 아키텍처 최적화가 필수적입니다.

이 글에 대한 큐레이터 의견

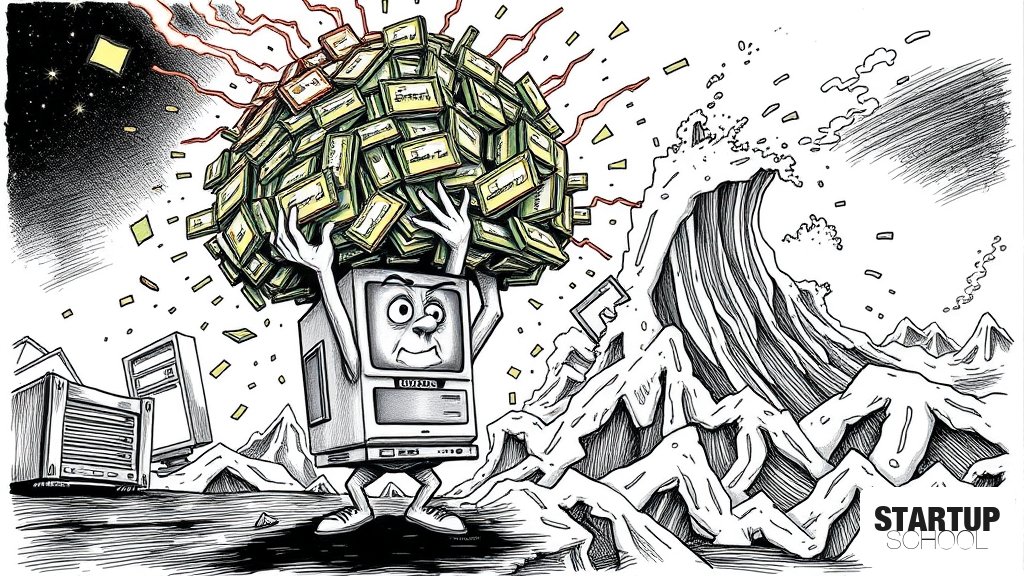

스타트업 창업자들에게 이 사례는 '무조건적인 스케일링(Scaling up)'의 위험성을 경고하는 강력한 메타포입니다. 많은 초기 스타트업이 서비스 성장 시점에 맞춰 서버 사양을 높이거나 더 많은 데이터를 적재하려 하지만, 만약 데이터베이스의 인덱싱 구조나 캐시 전략이 기존 아키텍처의 한계치에 맞춰져 있다면, 자원 증설은 오히려 비용 낭비와 성능 저하라는 '독'이 될 수 있습니다.

따라서 개발팀은 단순히 '더 큰 인스턴스'를 찾는 것이 아니라, 시스템의 병목(Bottleneck)이 어디인지, 즉 '캐시 가능한 영역'이 어디까지인지를 명확히 파악해야 합니다. 인프라 비용 최적화(FinOps) 관점에서 볼 때, 자원 투입의 임계점을 찾아내고 그 한계 내에서 효율을 극대화하는 아키텍처 설계 능력이 기업의 생존과 직결되는 핵심 경쟁력이 될 것입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.