OpenAI, 새로운 모델 GPT-2 출시하기에는 너무 위험하다고 밝혀 (2019)

(slate.com)

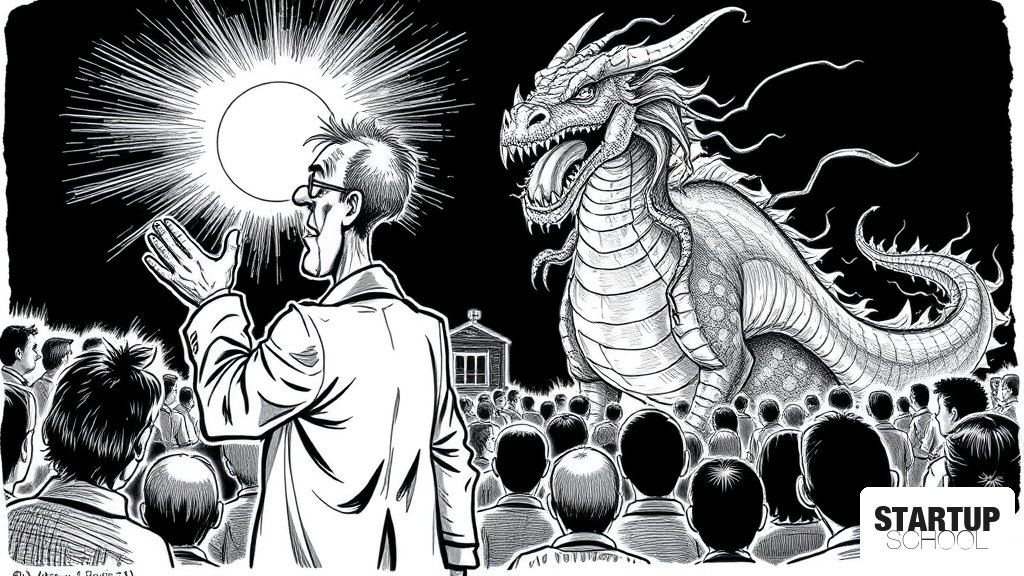

OpenAI가 2019년 GPT-2의 오남용 위험을 우려해 모델 공개를 유보한 결정은 AI 혁신과 사회적 안전성 사이의 갈등을 보여주며, AI Safety와 오픈 소스 모델의 공개 방식을 둘러싼 핵심적인 논쟁을 촉발했습니다.

이 글의 핵심 포인트

- 12019년 OpenAI, GPT-2의 전체 알고리즘 및 데이터셋 공개 유보

- 2사유: 가짜 뉴스 및 악의적 활용 등 '안전 및 보안 우려'

- 3GPT-2의 특징: 800만 개의 웹페이지 데이터를 학습하여 문맥에 맞는 텍스트 생성 가능