Pro Max 5x 할당량, 적당한 사용에도 1.5시간 만에 소진

(github.com)

Anthropic의 Claude Code 사용 중 Pro Max 5x 쿼터가 예상보다 훨씬 빠르게 소진되는 버그가 보고되었습니다. 원인은 프롬프트 캐싱(cache_read) 토큰이 할인된 비율이 아닌 전체 비율로 쿼터에 반영되어, 대규모 컨텍스트 사용 시 쿼터가 급격히 고갈되는 현상으로 추정됩니다.

이 글의 핵심 포인트

- 1Pro Max 5x 플랜 사용 중 1.5시간 만에 쿼터가 예상치 못하게 소진됨

- 2cache_read 토큰이 할인율(1/10)이 아닌 전체 비율로 쿼터에 반영되는 버그 의심

- 31M 컨텍스트 윈도우 사용 시, 단 한 번의 API 호출이 막대한 쿼터를 점유할 수 있는 구조적 위험

- 4사용자가 직접 조작하지 않는 백그라운드 세션이 공유 쿼터를 잠식하는 문제 발생

- 5Auto-compact 기능이 대규모 컨텍스트 생성 시 비용 스파이크를 유발하는 트리거로 작용

이 글에 대한 공공지능 분석

왜 중요한가?

AI 에이전트 및 코딩 도구의 비용 예측 불가능성을 보여주는 사례입니다. 쿼터 관리 실패는 단순한 불편함을 넘어, AI 기반 서비스를 운영하는 기업의 운영 비용(OpEx) 폭증과 서비스 가용성 저하로 직결될 수 있습니다.

어떤 배경과 맥락이 있나?

Anthropic의 Claude Code는 1M에 달하는 대규모 컨텍스트 윈도우와 프롬프트 캐싱을 핵심 경쟁력으로 내세우고 있습니다. 하지만 이번 버그 리포트는 캐싱 기술이 비용(Cost)은 줄여줄지언정, 호출 제한(Rate Limit) 측면에서는 무력화될 수 있는 구조적 허점을 지적합니다.

업계에 어떤 영향을 주나?

AI 에이전트 기반의 개발 환경(Agentic Workflow)이 확산됨에 따라, 토큰 계산 로직의 투명성이 중요해질 것입니다. 프롬프트 캐싱의 효율성이 쿼터 계산 방식에 따라 달라진다면, 개발자들은 대규모 컨텍스트를 다룰 때 극심한 비용 불확실성에 직면하게 됩니다.

한국 시장에 어떤 시사점이 있나?

LLM API 의존도가 높은 한국의 AI 스타트업들은 모델의 성능뿐만 아니라 '비용 효율적인 쿼터 관리'와 '캐싱 메커니즘의 정확한 이해'를 기술적 역량에 포함해야 합니다. 특히 멀티 세션 환경에서의 쿼터 공유 문제를 고려한 비용 최적화(FinOps) 전략이 필수적입니다.

이 글에 대한 큐레이터 의견

AI 에이전트 시대의 가장 큰 위협은 '비용의 불확실성'입니다. 이번 사례처럼 프롬프트 캐싱이 비용(Cost)은 줄여줄지언정 쿼터(Rate Limit)를 줄여주지 못한다면, 대규모 컨텍스트를 다루는 에이전트 서비스는 운영 단계에서 심각한 병목을 겪게 됩니다. 이는 개발자에게 '예측 가능한 비용 모델'이 기술력만큼이나 중요한 비즈니스 지표임을 시사합니다.

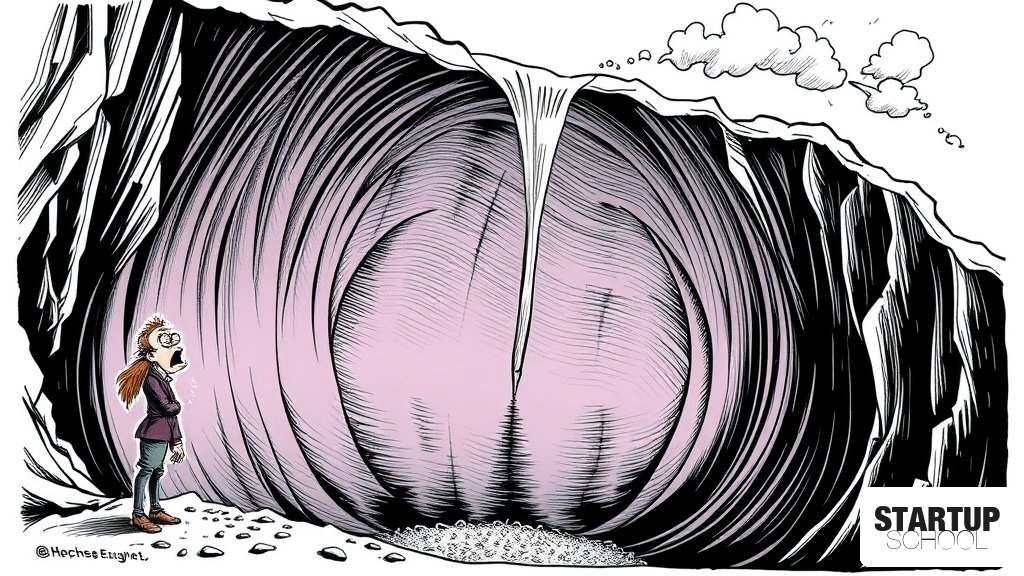

스타트업 창업자들은 LLM API를 도입할 때 단순히 '성능'만 볼 것이 아니라, 'Rate Limit 계산 로직'과 '캐싱 정책'을 면밀히 검토해야 합니다. 특히 사용자가 인지하지 못하는 백그라운드 세션이 쿼터를 잠식할 수 있는 구조라면, 자체적인 토큰 사용량 모니터링과 세션 관리 로직을 구현하는 것이 생존을 위한 필수적인 'AI FinOps' 전략이 될 것입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.