이 문서는 AI 스타트업 창업자들이 간과하기 쉬운, 하지만 결정적으로 중요한 '책임 있는 AI 설계'의 본질을 짚어줍니다. 기술적 우위에만 집중하여 '블랙박스'로 작동하는 AI를 만드는 것은 초기에는 빠를 수 있지만, 결국 시장의 신뢰를 얻지 못하고 규제 장벽에 부딪힐 것입니다. '실행 경계'는 AI가 자율성을 가질수록 인간의 통제와 책임 범위가 명확해야 한다는, 너무나 당연하면서도 구현하기 어려운 원칙을 다룹니다.

스타트업에게 이는 큰 기회가 될 수 있습니다. 단순히 AI 모델을 개발하는 것을 넘어, ISE 모델이나 9-Question Protocol과 같은 체계적인 접근 방식을 제품 설계 단계부터 통합하여 '안전하고 설명 가능한 AI'를 차별점으로 내세울 수 있습니다. 예를 들어, 산업용 로봇을 만드는 스타트업이라면, 로봇의 모든 행동 결정이 추적 가능하고, 어떤 상황에서 인간의 개입이 필요한지 명확히 정의된 시스템을 제공함으로써 경쟁 우위를 확보할 수 있습니다. 이는 단순한 기술 스택이 아니라, '책임감 있는 혁신'이라는 브랜드 가치를 구축하는 것입니다.

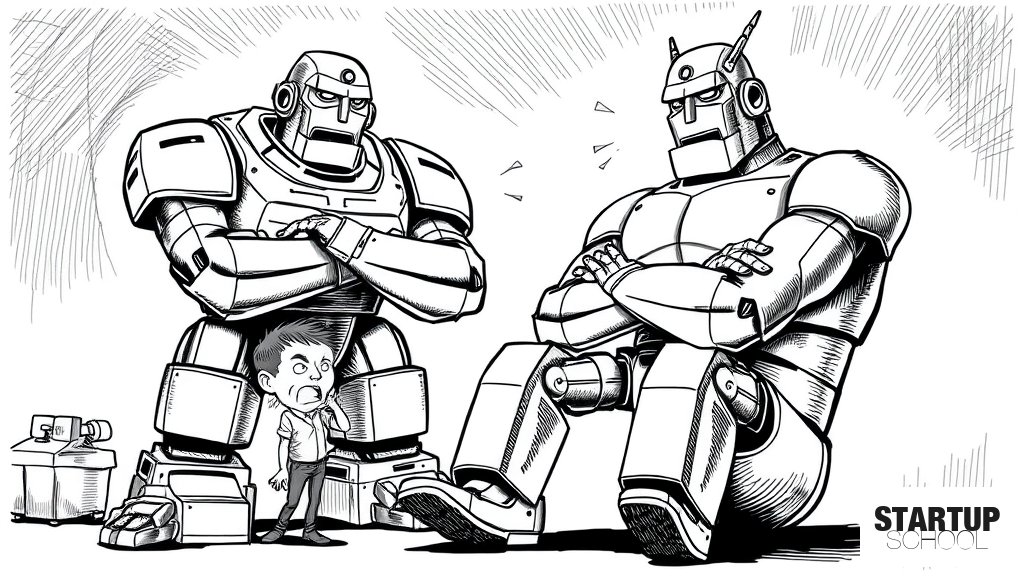

반대로, 이러한 논의를 등한시하고 오직 '더 똑똑한 AI'에만 몰두하는 스타트업은 잠재적 위협에 노출될 수 있습니다. AI 오작동으로 인한 사고 발생 시, 책임 소재가 불분명하면 법적 분쟁과 브랜드 이미지 실추를 피하기 어렵습니다. 따라서 AI 스타트업 창업자들은 '실행 경계'를 제품의 핵심 기능으로 간주하고, 이를 위한 디자인 및 개발 역량에 적극 투자해야 합니다. 나아가, AI의 '판단'과 '실행'을 분리하고 제어하는 솔루션, 즉 AI 거버넌스 및 감사 도구를 개발하는 전문 스타트업에게도 새로운 시장이 열릴 것입니다.