Show HN: Flint – 30B 모델, 반복 줄이기 위해 미세 조정

(springboards.ai)

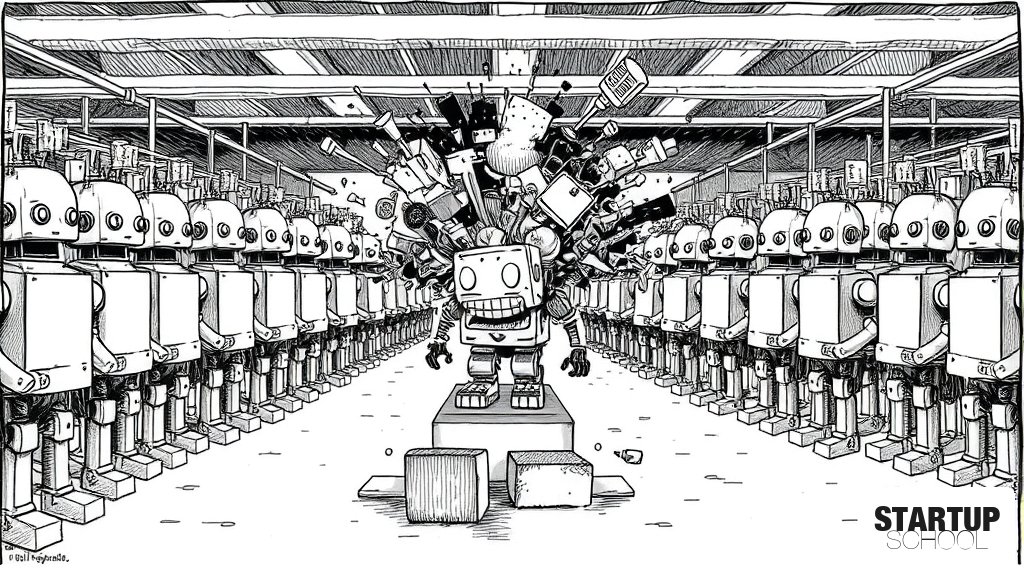

Springboards가 발표한 'Flint α'는 기존 거대 언어 모델(LLM)의 한계인 답변의 획기적인 획일화(Mode Collapse)를 해결하기 위해 설계된 30B 규모의 '발산형(Divergence) 모델'입니다. 이 모델은 정확도보다 창의적 영감을 중시하며, 특정 지점에서 엔트로피를 높이는 미세 조정을 통해 기존 SOTA 모델들보다 훨씬 다양하고 참신한 결과물을 생성합니다.

- 1Flint α는 NoveltyBench에서 7.47점을 기록하며, GPT-5.4(2.54), Gemini 3.1 Pro(3.19), Claude 4.6 Sonnet(1.83)을 압도하는 다양성을 증명함

- 2동일 프롬프트 50회 반복 시 내부 유사도(Intra-model similarity)가 0.721로, 경쟁 모델(0.864~0.905) 대비 현저히 낮음(낮을수록 다양함)

- 3Qwen3-30B-A3B 모델을 기반으로, 생성 과정의 핵심 지점에서 높은 엔트로피를 유지하도록 미세 조정됨

- 4AI의 '모드 붕괴(Mode Collapse)' 현상을 해결하여 창의적 산업(마케팅, 작가, 전략가 등)을 타겟팅함

- 5단순한 답변의 정확도가 아닌, '발산적 사고(Divergent Thinking)'를 구현하기 위한 구조적 변동성(Structured Variation) 제공

왜 중요한가

배경과 맥락

업계 영향

한국 시장 시사점

AI 모델의 경쟁 구도가 '지능의 높이'에서 '사고의 너비'로 이동하고 있음을 보여주는 상징적인 사례입니다. 지금까지의 LLM 개발이 '똑똑한 비서'를 만드는 과정이었다면, Flint는 '창의적인 파트너'를 만드는 데 집중하고 있습니다. 이는 스타트업 창업자들에게 모델의 크기(Parameter)나 단순 성능(Benchmark) 경쟁이 아닌, 모델의 '성격'과 '사고 프로세스'를 어떻게 설계할 것인가라는 새로운 전략적 질문을 던집니다.

창업자들은 이제 '어떤 데이터를 넣을 것인가'를 넘어 '어떤 확률 분포를 유도할 것인가'를 고민해야 합니다. 만약 여러분이 콘텐츠 생성, 광고 카피라이팅, 혹은 전략 컨설팅 솔루션을 개발하고 있다면, 기존의 GPT나 Claude가 주는 '안전하고 뻔한 답변'이 서비스의 가치를 깎아먹고 있지는 않은지 점검해야 합니다. Flint의 사례처럼, 특정 태스크를 위해 의도적으로 '불확실성(Entropy)'을 제어하는 기술적 접근이 차세대 버티컬 AI의 핵심 경쟁력이 될 것입니다.

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.