Show HN: Gox – LLM으로 작성된 코드에 적합한 Go 정적 분석 도구

(github.com)

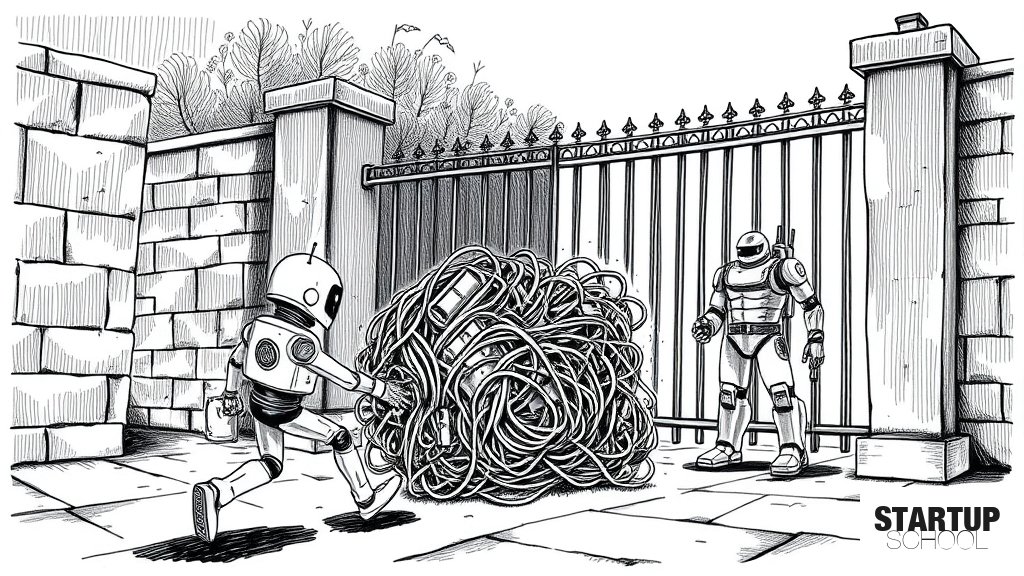

Gox는 Claude Code와 같은 AI 코딩 에이전트가 작성한 코드에서 발생할 수 있는 미세한 버그를 잡아내기 위해 설계된 엄격한 Go 정적 분석 도구입니다. 기존 린터가 단순 경고를 제공하는 '탐지기(Detector)'라면, Gox는 명확한 근거 없이는 통과할 수 없는 '게이트(Gate)' 역할을 수행하며 AI 에이전트의 코딩 실수를 원천 차단하는 데 집중합니다.

이 글의 핵심 포인트

- 1AI 에이전트(Claude Code 등)의 코딩 실수를 방지하기 위해 '에러(Error)'를 기본값으로 하는 엄격한 Gate 방식 채택

- 2동일 타입 인자가 연속될 때 주석(`/* paramName */`)을 강제하여, AI가 인자 순서를 뒤바꾸는 버그를 원천 차단

- 3외부 의존성 없이 Go 표준 라이브러리만 사용하여 442개 패키지 기준 Cold run 9.4초라는 압도적 성능 구현

- 4Claude Code와 통합되어 에이전트의 작업이 완료된 후 오류가 발견되면 다음 단계 진행을 즉시 차단(Stop hook)하는 기능 제공

- 5단순 경고를 넘어, 예외 허용 시 반드시 이유를 명시하도록 강제하여 코드의 투명성과 책임 소재 명확화

이 글에 대한 공공지능 분석

왜 중요한가

AI 에이전트가 코드를 작성하는 속도가 인간을 압도하면서, 기존의 '경고 후 검토' 방식으로는 AI가 생성하는 '조용한 버그(Silent Bugs)'를 감당할 수 없게 되었습니다. Gox는 개발 패러다임이 '인간 중심'에서 'AI 에이전트 중심'으로 전환됨에 따라 필요한 새로운 차원의 코드 검증 표준을 제시합니다.

배경과 맥락

최근 Claude Code, Cursor 등 자율형 코딩 에이전트의 등장은 개발 생산성을 폭발시켰지만, 동시에 타입이 같은 인자 순서를 뒤바꾸는 등의 논리적 오류를 양산하고 있습니다. Gox는 이러한 AI 특유의 오류 패턴을 타겟팅하여, 정적 분석을 통해 에이론트엔드(Agent-end)의 신뢰성을 확보하려는 시도입니다.

업계 영향

이 도구의 등장은 'AI-Native DevTools'라는 새로운 카테고리의 탄생을 예고합니다. 단순한 코드 완성 도구를 넘어, AI의 작업 결과물을 검증하고 승인하는 'AI 거버넌스(AI Governance)' 도구의 중요성이 커질 것이며, 이는 향후 CI/CD 파이프라인의 핵심 구성 요소가 될 것입니다.

한국 시장 시사점

인력 효율화를 위해 AI 도입을 서두르는 한국 스타트업들에게 Gox의 접근 방식은 중요한 시사점을 줍니다. AI 도입의 속도보다 중요한 것은 'AI가 만든 기술 부채를 어떻게 통제할 것인가'이며, Gox와 같은 'Fail-closed(실패 시 차단)' 방식의 가드레일 구축이 필수적입니다.

이 글에 대한 큐레이터 의견

스타트업 창업자 관점에서 Gox는 단순한 오픈소스 도구 이상의 의미를 갖습니다. 현재 많은 기업이 LLM을 활용해 개발 속도를 높이려 하지만, 그 이면에는 AI가 생성한 미세한 논리 오류가 운영 환경(Production)으로 침투할 위험이 상존합니다. Gox는 이 위험을 '비용'이 아닌 '프로세스'로 해결하려는 영리한 접근을 보여줍니다.

기회 측면에서, AI 에이전트의 신뢰성을 보장하는 '검증 레이어'를 구축하는 것은 향후 거대한 비즈니스 기회가 될 것입니다. 개발자들에게는 '코드를 쓰는 능력'보다 'AI가 쓴 코드를 검증하는 규칙(Rule)을 설계하는 능력'이 더 중요해질 것입니다. 반면, 기존의 느슨한 린팅 규칙에 의존하던 팀들에게는 Gox와 같은 엄격한 도구가 개발 속도를 저해하는 장애물로 느껴질 수 있으므로, 조직 차원의 적응 전략이 필요합니다.

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.