Show HN: TiGrIS, ML 모델을 임베디드 장치에 맞게 배치하는 타일링 컴파일러

(github.com)

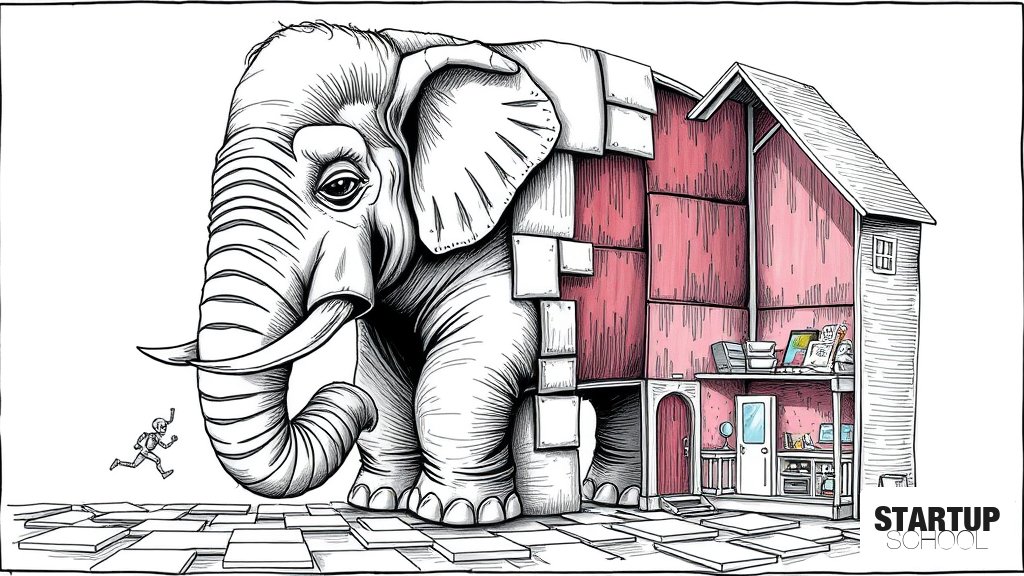

TiGrIS는 메모리 용량이 극도로 제한된 임베디드 장치에서 대규모 ML 모델을 실행할 수 있도록 돕는 AOT(Ahead-of-Time) 타일링 컴파일러입니다. 모델의 정확도를 희생하며 크기를 줄이는 기존 방식 대신, 연산 그래프를 분할하고 타일링하여 SRAM 사용량을 최소화하는 혁신적인 접근법을 제시합니다.

이 글의 핵심 포인트

- 1모델 크기를 줄이지 않고 연산 그래프를 분할/타일링하여 SRAM 사용량 최소화

- 2MobileNetV2 기준, 4.59 MiB의 피크 메모리를 254.62 KiB로 약 94.5% 감소 가능

- 3인터프리터나 동적 메모리 할당이 없는 Zero dynamic allocation 방식의 바이너리 플랜 생성

- 4ESP32, Cortex-M 등 다양한 타겟에 대해 백엔드별 C 코드 생성 지원

- 5ONNX 모델을 입력으로 받아 타겟 하드웨어에 최적화된 .tgrs 바이너리 출력

이 글에 대한 공공지능 분석

왜 중요한가

기존의 Edge AI 개발은 모델의 정확도를 포기하면서까지 크기를 줄이는(Quantization, Pruning) 고통스러운 최적화 과정을 거쳐야 했습니다. TiGrIS는 모델 자체를 수정하는 대신 연산 방식을 재구성함으로써, 고성능 모델을 저사양 하드웨어에서도 구현할 수 있는 새로운 패러다임을 제시합니다.

배경과 맥락

최근 IoT 및 웨어러블 기기 시장은 초저전력, 초저가 하드웨어를 선호하지만, 탑재 가능한 AI 모델의 크기는 SRAM 용량(수백 KB 단위)에 의해 엄격히 제한됩니다. 이러한 '메모리 병목 현상'은 고도화된 AI 기능을 저가형 칩셋에 이식하는 데 가장 큰 기술적 장벽으로 작용해 왔습니다.

업계 영향

하드웨어 제조사는 더 비싼 칩셋을 사용할 필요 없이 기존의 저사양 칩셋으로도 고성능 AI 기능을 제공할 수 있어 BOM(Bill of Makers) 비용을 절감할 수 있습니다. 이는 AI 소프트웨어 개발자에게는 모델 최적화에 드는 R&D 비용을 획기적으로 줄여주는 기회가 됩니다.

한국 시장 시사점

반도체 및 IoT 디바이스 제조 역량이 뛰어난 한국의 하드웨어 스타트업들에게 큰 기회입니다. 저사양 MCU 기반의 스마트 가전, 산업용 센서, 웨어러블 기기 개발 시, 모델 경량화에 매몰되지 않고도 차별화된 AI 기능을 탑재하여 제품 경쟁력을 확보할 수 있습니다.

이 글에 대한 큐레이터 의견

스타트업 창업자 관점에서 TiGrIS는 '하드웨어 비용 절감'과 '제품 성능 유지'라는 두 마리 토끼를 잡을 수 있는 강력한 무기입니다. 기존에는 고성능 AI 기능을 넣기 위해 반드시 더 비싼 프로세서를 채택해야 했으나, 이 기술을 활용하면 소프트웨어 레벨의 컴파일 최적화만으로도 하드웨어 사양을 낮추면서 제품의 지능을 높일 수 있습니다.

다만, 실행 시 'Zero dynamic allocation'을 지향한다는 점은 개발자에게 정교한 메모리 설계 능력을 요구할 수 있습니다. 런타임의 복잡도는 낮아졌지만, 컴파일 타임에 정밀한 메모리 버젯(Budget)을 설정하고 관리해야 하는 운영상의 숙제가 남습니다. 따라서 임베디드 AI 솔루션을 개발하는 팀은 이 컴파일러를 워크플로우에 통합하여, 모델 설계와 하드웨어 제약 사항 사이의 간극을 자동으로 메우는 자동화된 파이프라인을 구축하는 데 집중해야 합니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.