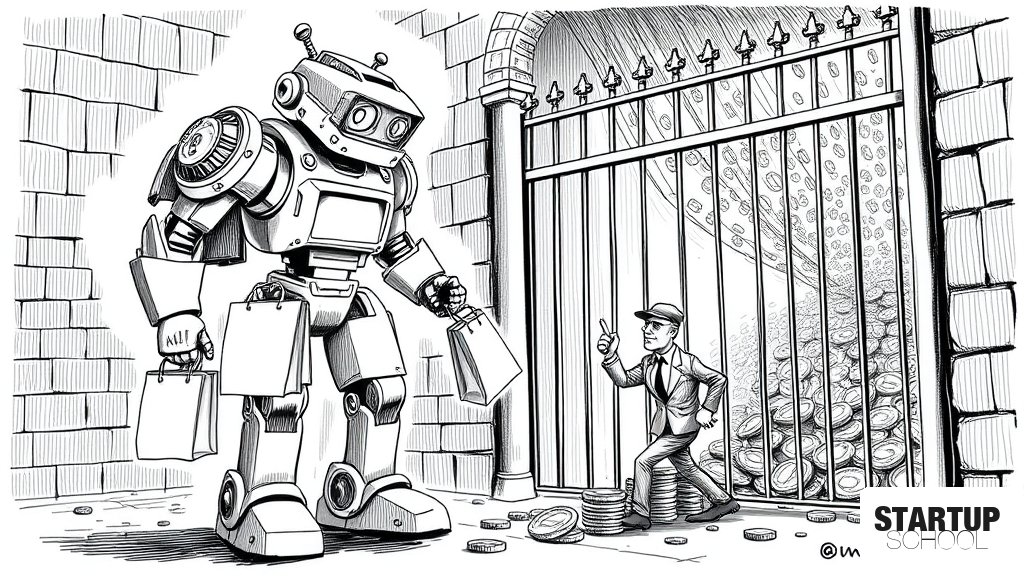

알지 못하는 사이에 놓치고 있는 고객들

(brightedge.com)

AI 에이전트 트래픽이 인간의 검색량을 위협할 정도로 급증하고 있으나, 많은 기업이 보안 및 기존 크롤러 정책으로 인해 이들을 의도치 않게 차단하고 있습니다. 이는 브랜드 인지도 하락과 잠재 고객 유실로 이어지는 심각한 비즈니스 리스크를 초래합니다.

이 글의 핵심 포인트

- 1인간 검색 100회당 AI 에이전트 방문은 평균 88회에 달함

- 2현재 AI 에이전트 활동의 약 95%가 OpenAI에 집중되어 있음

- 3기업의 77%가 브랜드 학습을 담당하는 GPTBot을 차단하여 정보 왜곡 위험 초래

- 4ChatGPT-User(실시간 사용자 대리 에이전트)의 약 16%가 서버 오류나 차단으로 인해 실패함

- 5전통적인 웹 분석 도구(Google Analytics 등)로는 AI 에이전트의 접근 실패를 파악하기 어려움

이 글에 대한 공공지능 분석

왜 중요한가

AI 에이전트는 이제 단순한 배경 소음이 아니라 인간 검색에 필적하는 주요 트래픽 채널로 부상했습니다. 이들을 차단하는 것은 잠재적 고객이 우리 브랜드를 발견하고 의사결정을 내릴 기회를 스스로 제거하는 것과 같습니다.

배경과 맥락

OpenAI를 중심으로 한 AI 에이전트의 확산으로 웹 트래픽의 성격이 '인간의 클릭'에서 '에이전트의 데이터 수집 및 실시간 검색'으로 급격히 변화하고 있습니다. 현재 에이전트 활동의 95%가 OpenAI에 집중되어 있어, 이에 대한 대응이 곧 글로벌 경쟁력과 직결됩니다.

업계 영향

디지털 마케팅과 IT/DevOps 팀 간의 협업이 필수적입니다. 단순한 robots.txt 수정을 넘어, 에이전트의 목적(학습용 vs 실시간 검색용)에 따라 차별화된 접근 제어 및 인프라 최적화 전략이 필요합니다.

한국 시장 시사점

글로벌 시장을 타겟으로 하는 한국 스타트업은 AI 에이전트에게 '읽히지 않는 서비스'가 될 위험이 큽니다. 기존의 보안 중심적 봇 차단 정책을 재점검하고, AI 에이전트 친화적인 'Agentic SEO' 전략을 도입해야 합니다.

이 글에 대한 큐레이터 의견

AI 에이전트의 등장은 SEO(검색 엔진 최적화)의 패러다임을 '키워드 중심'에서 '데이터 접근성 및 신뢰성 중심'으로 완전히 바꾸고 있습니다. 창업자들은 이제 웹사이트가 인간에게만 잘 보이는 것을 넘어, AI 에이전트가 정확한 정보를 오류 없이 가져갈 수 있는 '기계 친화적 구조'를 갖추었는지 점검해야 합니다.

특히, 보안을 이유로 모든 스크래퍼를 차단하는 관행은 AI 시대에 치명적인 독이 될 수 있습니다. 403 에러(권한 거부)로 인해 고객의 실시간 질문에 답변하지 못하는 상황은 브랜드 신뢰도에 즉각적인 타격을 줍니다. 따라서 기술 팀은 에이전트의 유형(GPTBot, OAI-SearchBot, ChatGPT-User)을 구분하여, 학습용 봇은 브랜드 인지도를 위해 허용하되, 실시간 사용자 대리 봇은 최우성적으로 접근할 수 있도록 인프라를 재설계하는 전략적 유연성을 갖춰야 합니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.