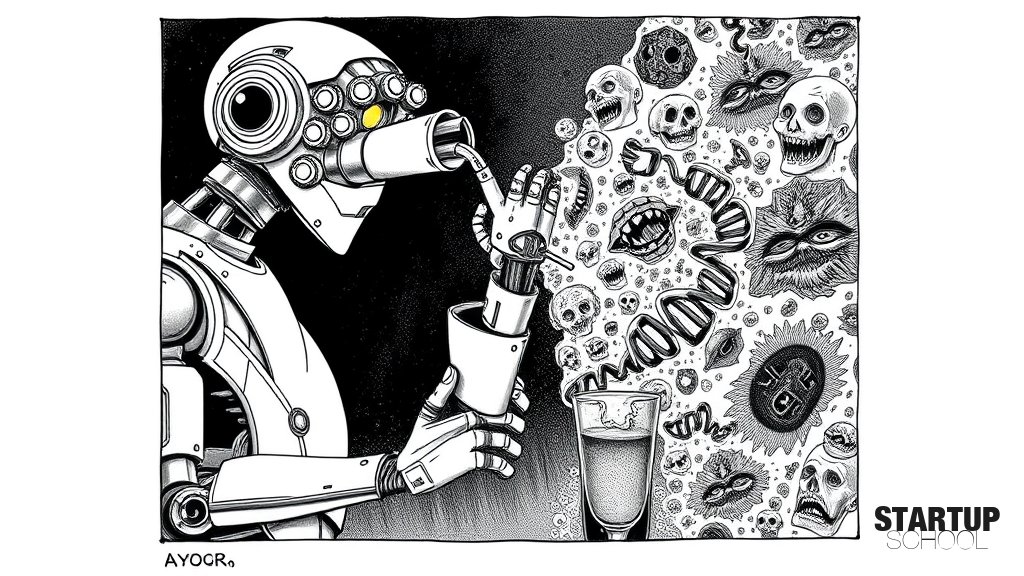

gen AI Kool-Aid가 eugenics 맛이 난다

(theverge.com)

다큐멘터리 '공각기동대'는 현대 생성 AI의 근간을 이루는 통계 기법이 인종차별적 유사과학인 우생학에서 비롯되었음을 폭로하며 기술에 내재된 편향성의 근원을 파헤친다.

이 글의 핵심 포인트

- 1다큐멘터리 '공각기동대'는 현대 생성 AI의 기술적 뿌리가 인종차별적 유사과학인 우생학에 닿아있다고 주장한다.

- 2우생학자 프랜시스 골턴과 칼 피어슨이 개발한 통계 기법(예: 로지스틱 회귀)이 현대 머신러닝의 핵심 기반이 되었다는 역사적 연결고리를 제시한다.

- 3AI 편향성의 원인을 '잘못된 데이터' 문제를 넘어, 기술의 개념적, 수학적 프레임워크 자체에 내재된 문제로 재정의한다.

이 글에 대한 공공지능 분석

이 기사는 다큐멘터리 '공각기동대(Ghost in the Machine)'를 통해 현재 기술 업계의 최대 화두인 생성 AI의 근원에 대한 매우 중요하고 도발적인 문제를 제기한다. 분석의 핵심은 AI의 편향성 문제가 단순히 '쓰레기 데이터가 들어가면 쓰레기 결과가 나온다(GIGO)'는 차원을 넘어, 기술의 근간을 이루는 통계적, 철학적 기반 자체가 인종차별적 유사과학인 우생학에 깊이 뿌리내리고 있다는 주장이다. 이는 AI를 순수하고 객관적인 수학적 도구로 여기는 일반적인 인식을 정면으로 반박하며, 기술의 역사적, 사회적 맥락을 성찰해야 할 필요성을 역설한다.

배경을 살펴보면, 다큐멘터리는 AI의 계보를 1956년 존 매카시가 '인공지능'이라는 용어를 만든 시점보다 훨씬 이전인 빅토리아 시대 영국으로 거슬러 올라간다. 찰스 다윈의 사촌이자 우생학의 창시자인 프랜시스 골턴은 인간을 '우월한' 인종과 '열등한' 인종으로 나누고, 이를 통계적으로 정량화하려 시도했다. 그의 제자 칼 피어슨은 이러한 사상을 바탕으로 현대 머신러닝의 핵심 요소인 로지스틱 회귀와 같은 통계 도구를 개발했다. 즉, 인간을 분류하고 서열화하려는 우생학적 목표가 오늘날 AI 알고리즘의 수학적 토대를 마련했다는 것이다.

이러한 분석은 AI 기술에 대한 담론에 지대한 영향을 미칠 수 있다. AI의 편향성 문제를 해결하기 위해 데이터셋을 정제하거나 알고리즘을 일부 수정하는 기술적 접근만으로는 부족하며, AI의 개발 목표와 기본 설계 사상 자체를 근본적으로 재검토해야 한다는 주장에 힘을 싣는다. 이는 AI 윤리, 규제, 그리고 기술 개발의 방향성에 대한 논의를 더욱 심도 있는 차원으로 이끌 수 있다. 기술 기업들은 자신들의 제품이 의도치 않게 차별적 이데올로기를 재생산하고 증폭시킬 수 있다는 비판에 직면하게 되며, 이는 중대한 평판 리스크로 작용할 수 있다.

궁극적으로 이 기사와 다큐멘터리가 시사하는 바는 기술 개발에 있어 역사적, 사회학적 통찰이 필수적이라는 점이다. 기술 중립성이라는 신화에서 벗어나, 기술이 탄생하고 발전해 온 과정에 어떤 이데올로기가 스며들어 있는지를 비판적으로 성찰해야 한다는 것이다. '더 윤리적인 AI'를 구축하기 위해서는 코드 수정 이상의 노력이 필요하며, 기술의 근원에 자리한 '유령', 즉 우생학과 같은 차별적 사상과 정면으로 마주해야 한다는 강력한 메시지를 던진다.

이 글에 대한 큐레이터 의견

이 기사가 조명하는 '공각기동대'의 관점은 AI 산업의 유토피아적 자기 서사에 대한 필수적인 반론이다. AI의 통계적 기반과 우생학을 연결하는 이 주장은 AI 편향성 문제를 기술적 결함이 아닌, 설계에 내재된 철학적 특징으로 재정의한다. 인간의 특성을 정량화하고 예측하려는 현대 AI의 목표가 인간을 분류하고 서열화하려 했던 우생학의 방법론적, 이념적 유산과 맞닿아 있다는 통찰은 매우 설득력 있다.

이러한 비판적 시각은 기술의 사회적 책임을 묻는 중요한 계기를 마련한다. 측정 도구 자체가 인종차별적 이론을 증명하기 위해 개발되었다면, 그 도구의 중립성을 당연하게 받아들일 수 없다는 지적은 타당하다. 이는 기술 업계가 단순히 '데이터' 문제 뒤에 숨는 것을 넘어, 자신들이 사용하는 알고리즘의 역사적 뿌리와 그것이 내포하는 위험성을 직시해야 한다는 불편한 진실을 제기한다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.