추론 최적화의 부상: 2026년을 빚어낼 LLM 인프라의 핵심 트렌드

(dev.to)

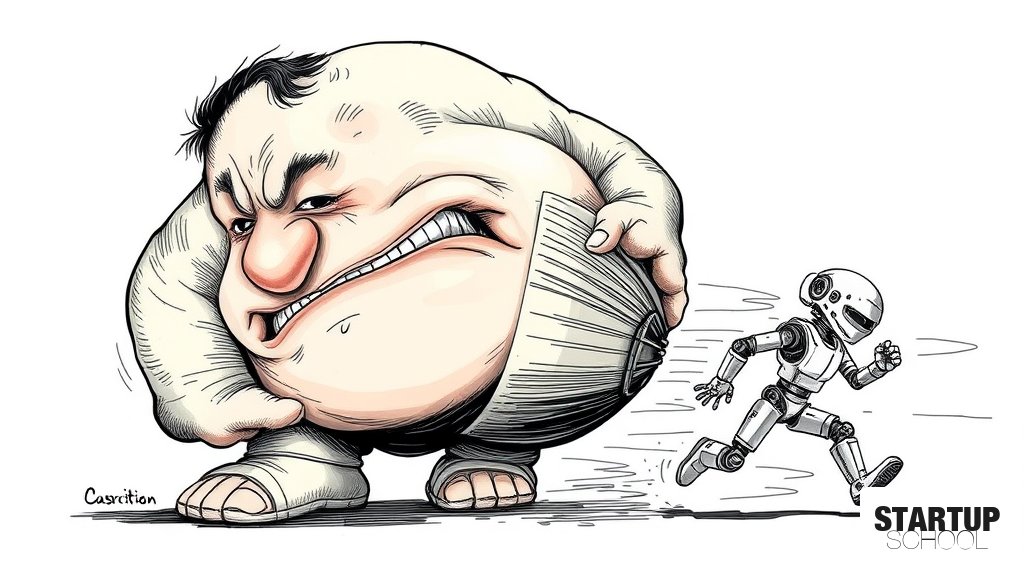

LLM 기술의 패러다임이 모델의 크기를 키우는 '학습(Training)' 중심에서, 효율적으로 실행하는 '추론(Inference) 최적화' 중심으로 이동하고 있습니다. 비용 절감과 지연 시간 단축을 위한 양자화, 스마트 라우팅, 스펙큘레이티브 디코딩 등의 기술이 향후 AI 서비스의 수익성과 경쟁력을 결정짓는 핵심 요소가 될 것입니다.

이 글의 핵심 포인트

- 1추론 비용은 서비스 운영의 지속 가능성을 결정하는 핵심 변수임

- 2모델 양자화(Quantization)를 통해 정밀도를 낮추고 메모리 사용량과 속도를 개선 가능

- 3