분산 AI에서 아무도 이야기하지 않는 스케일링 법칙

(dev.to)

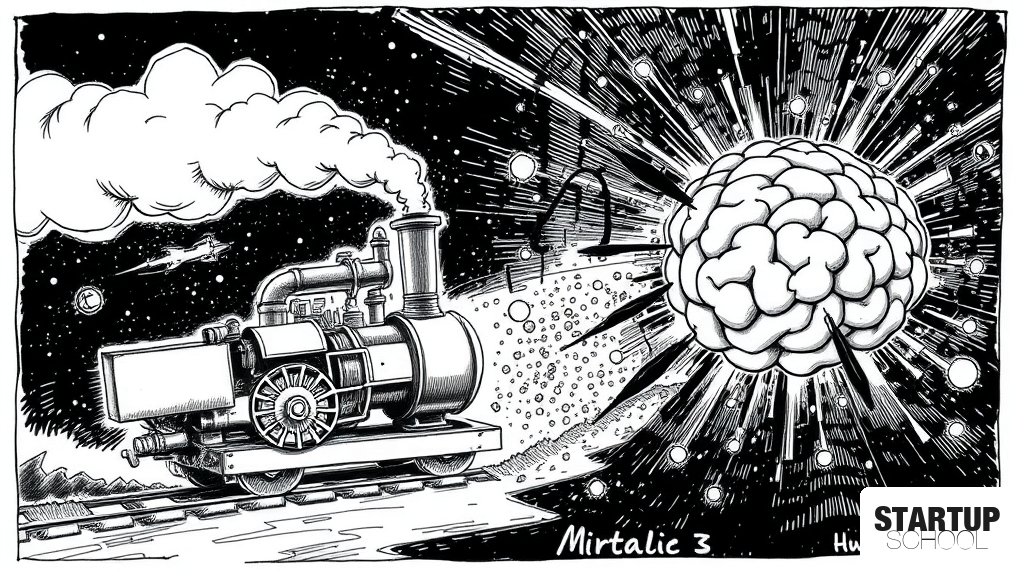

기존 AI 스케일링 법칙이 모델 크기와 데이터 양에 집중했다면, 이 글은 분산된 연구 환경에서 지능이 폭발적으로 성장할 수 있는 새로운 법칙인 '합성 경로(Synthesis Paths)'를 제시합니다. 핵심은 모델 가중치를 공유하는 기존 연합 학습(Federated Learning)의 한계를 넘어, 초경량 '결과 패킷(Outcome Packet)'을 통해 비용은 로그 단위로 낮추고 지능은 이차 함수적으로 늘리는 QIS(Quadratic Intelligence Swarm) 아키텍처입니다.

이 글의 핵심 포인트

- 1분산 지능의 핵심 스케일링 법칙은 모델 크기가 아닌 '합성 경로(Synthesis Paths)'의 수임

- 2지능은 노드 수(N)에 따라 이차 함수(N^2)로 증가하고, 통신 비용은 로그 함수(log N)로 제어 가능

- 3