결제 서비스 다운시킨 Spot Instance (그리고 47분 만에 찾은 이유)

(dev.to)

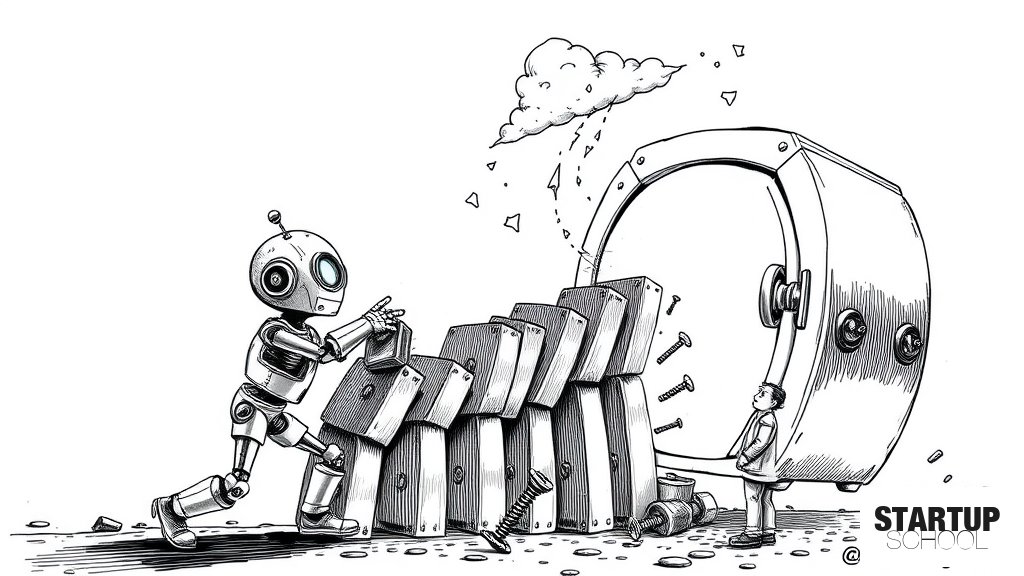

Spot Instance의 노드 교체로 인해 Redis가 재시작되자, 과도하게 짧게 설정된 Kubernetes Liveness Probe가 결제 서비스를 연쇄적으로 중단시킨 장애 사례입니다. 2줄의 설정 변경으로 해결되었지만, 원인 파점의 시행착오로 인해 47분이 소요된 디버깅 과정을 다룹니다.

이 글의 핵심 포인트

- 12줄의 YAML 수정으로 해결되었으나 원인 파악에 47분 소요

- 2Spot Instance의 노드 교체로 인한 Redis 재시작이 근본 원인

- 3Liveness Probe의 타임아웃(2초)이 Redis 준비 시간(3-4초)보다 짧아 발생한 장애

- 4로그와 배포 이력에 매몰되어 인프라 이벤트(kube-system events) 확인이 늦어짐

- 5해결책으로 Liveness Probe의 timeoutSeconds와 initialDelaySeconds를 상향 조정

이 글에 대한 공공지능 분석

왜 중요한가?

단순한 코드 오류가 아닌, 인프라의 변동성(Spot Instance)과 설정값(Probe Timeout) 사이의 상호작용이 어떻게 대규모 장애로 번질 수 있는지 보여줍니다. 이는 시스템의 안정성이 개별 컴포넌트의 건전성이 아닌, 컴포넌트 간의 '타이밍'과 '상호 의존성'에 달려 있음을 시사합니다.

어떤 배경과 맥락이 있나?

클라우드 비용 절감을 위해 AWS Spot Instance를 사용하는 환경에서는 노드가 예고 없이 교체될 수 있습니다. 이때 Kubernetes의 Liveness Probe는 서비스의 생존을 확인하는 핵심 도구이지만, 의존성 서비스(Redis 등)의 재시작 시간을 고려하지 않은 공격적인 설정은 오히려 장애를 증폭시키는 독이 됩니다.

업계에 어떤 영향을 주나?

인프라 비용 최적화(Cost Optimization)와 서비스 가용성(Availability) 사이의 트레이드오프를 재고하게 만듭니다. DevOps 엔지니어들에게는 로그 분석을 넘어 '이벤트 로그(Event Log)'를 통한 인프라 수준의 관측성(Observability) 확보가 장애 대응의 핵심임을 강조합니다.

한국 시장에 어떤 시사점이 있나?

클라우드 비용에 민감한 한국 스타트업들에게 Spot Instance 활용은 필수적이지만, 이번 사례처럼 '설정의 디테일'이 결여된 운영은 치명적인 결제 장애로 이어질 수 있습니다. 인프라의 불확실성을 상수로 두고, 서비스의 생존 확인 로직을 보다 탄력적으로 설계하는 역량이 운영의 핵심 경쟁력입니다.

이 글에 대한 큐레이터 의견

이 사례의 핵심은 '문제의 원인'이 아니라 '문제 해결의 비효율성'에 있습니다. 엔지니어가 가장 먼저 확인해야 할 곳이 배포 이력이 아닌 인프라 이벤트(Node Event)였다는 점은, 장애 대응 시 '확증 편향'이 얼마나 큰 시간 손실을 초래하는지 보여주는 전형적인 사례입니다. 창업자들은 엔지니어링 팀이 단순히 '로그를 보는 것'을 넘어, 시스템 전체의 인프라 흐름을 읽는 '관측성(Observability)' 역량을 갖추었는지 점검해야 합니다.

스타트업 관점에서 이는 기술적 부채가 단순히 '나쁜 코드'에 국한되지 않음을 의미합니다. 비용 절감을 위해 도입한 Spot Instance나, 효율성을 위해 설정한 짧은 타임아웃 같은 '최적화된 설정'이 적절한 가드레일 없이 운영될 때 가장 위험한 시한폭탄이 됩니다. 따라서 인프라의 변동성을 상수로 두고, 서비스의 생존 확인 로직을 보다 관대하고 탄력적으로 설계하는 '방어적 운영(Defensive Operations)' 전략이 필요합니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.