프롬프트 단위 테스트: 프로덕션 AI 신뢰성 확보의 핵심

(dev.to)

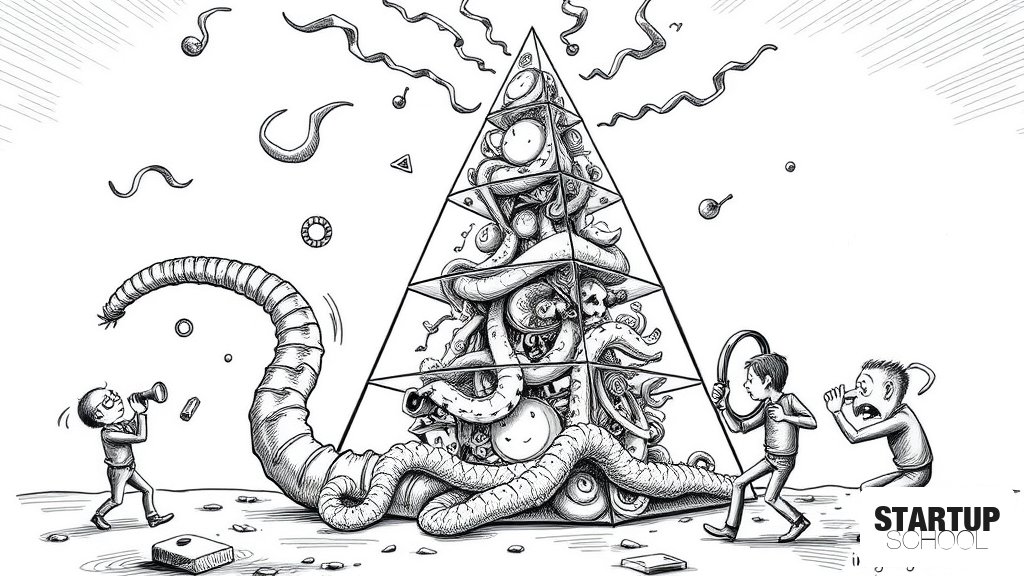

이 글은 Large Language Model(LLM)의 예측 불가능성 문제를 해결하고 프로덕션 환경에서 AI 애플리케이션의 신뢰성을 확보하기 위한 '프롬프트 단위 테스트(Unit Testing Prompts)' 방법론을 제시합니다. 전통적인 결정론적 테스트 방식의 한계를 지적하며, 결정론적 검증, 의미론적 유사성 검사, 그리고 LLM-as-a-Judge 방식을 포함하는 3단계 테스트 피라미드를 제안합니다. 이를 CI/CD 파이프라인에 통합하여 회귀 방지, 비용 관리, 행동 가드레일 역할을 수행함으로써 LLM 기반 서비스의 품질과 일관성을 유지할 수 있도록 돕습니다.

이 글의 핵심 포인트

- 1LLM의 확률적, 비결정론적 특성 때문에 기존 결정론적 단위 테스트는 LLM 기반 애플리케이션에 부적합하다.

- 2'프롬프트 단위 테스트'는 LLM 출력의 품질과 일관성을 보장하여 프로덕션 AI 신뢰성 확보의 핵심 방법론이다.

- 3