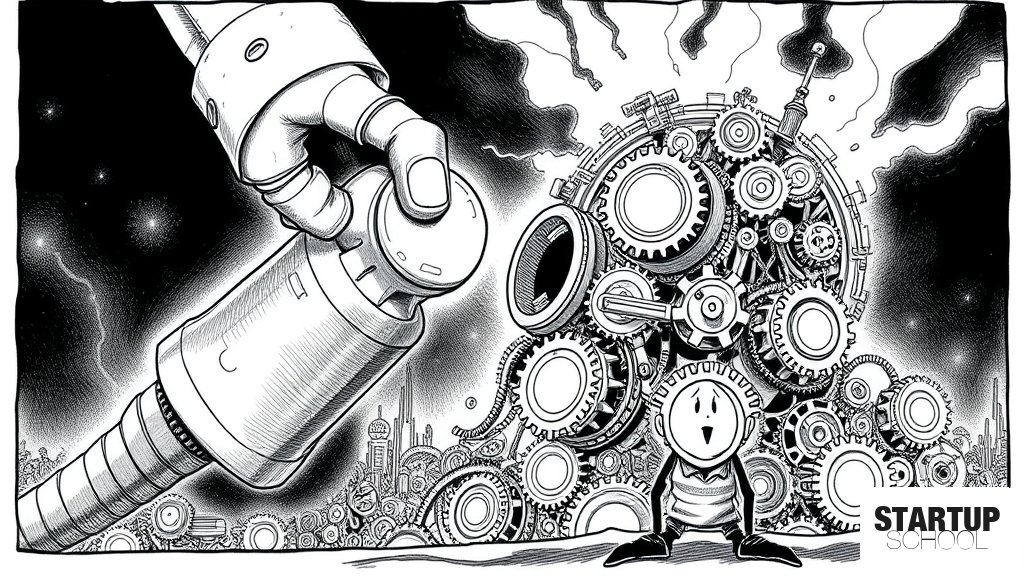

LLM 제공업체가 프로덕션 도중 유스케이스 사용을 금지할 때 벌어지는 일

(dev.to)

LLM 제공업체의 갑작스러운 유스케이스 차단이 초래하는 서비스 중단 리스크를 조명하며, 비즈니스 생존을 위해 공급망 의존도를 낮추는 Model-agnostic 아키텍처와 하이브리드 전략 구축의 필요성을 강조한다.

이 글의 핵심 포인트

- 1OpenClaw 사례: Anthropic의 정책 집행으로 인해 4만 개의 도구가 포함된 운영 파이프라인이 예고 없이 중단됨

- 2단일 제공업체 의존성의 위험성: 정책 변경, 속도 제한(Rate Limit), 지역적 장애에 매우 취약함

- 3해결책으로서의 추상화 레이어: 모델 간의 차이를 메우는 인터페이스, 라우팅 레이어, 관측성(Observability) 구축 필요