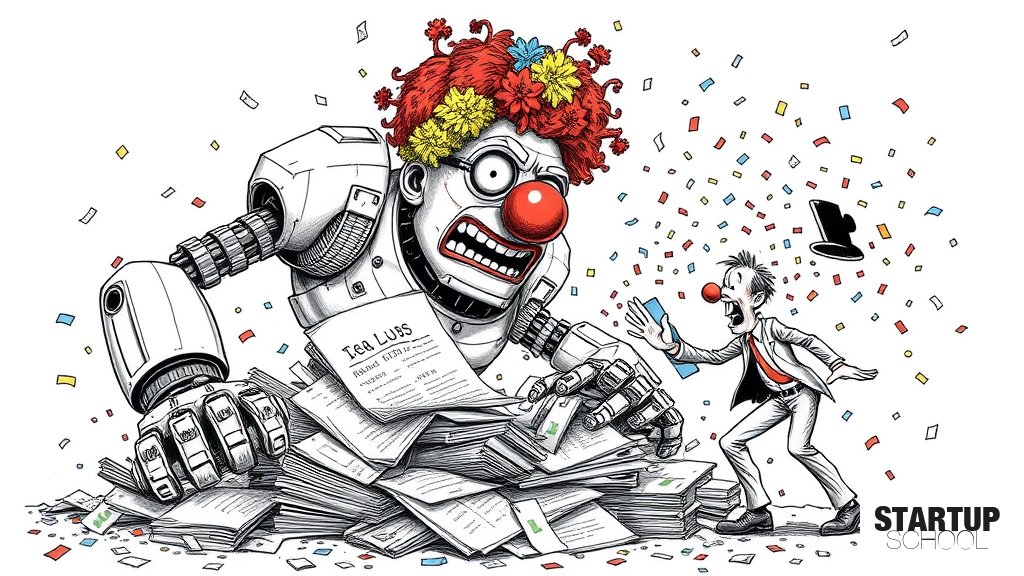

이번 마이크로소프트의 '오락용' 약관 논란은 스타트업 창업자들에게 두 가지 중요한 교훈을 줍니다. 첫째, 현재의 '범용' 대규모 AI 모델은 여전히 기술적 한계, 즉 '환각' 현상을 안고 있으며, 이는 거대 기업조차 법적 면책 조항으로 방어할 수밖에 없는 현실이라는 점입니다. 이는 AI를 사업화할 때 고객들에게 과장된 기대를 심어주는 것이 얼마나 위험한지 경고합니다. 스타트업은 기술의 한계를 명확히 인지하고, 마케팅과 실제 제품 개발에 있어 현실적인 기대를 설정해야 합니다.

둘째, 이러한 한계는 오히려 새로운 비즈니스 기회를 창출합니다. 만약 마이크로소프트의 Copilot이 법률 문서 검토나 의료 진단 보조와 같은 '중요한 조언'에 사용할 수 없다면, 해당 분야에서는 '신뢰할 수 있는 AI'에 대한 수요가 폭발적으로 늘어날 것입니다. 한국의 스타트업들은 특정 산업 도메인에 특화하여 환각을 최소화하고 정확도를 극대화할 수 있는 파인튜닝 모델 개발, 또는 AI의 출력을 검증하고 보완하는 'AI 가드레일' 솔루션 개발에 집중할 수 있습니다. 예를 들어, 특정 법률 분야의 최신 판례 데이터만으로 학습하고 인간 변호사의 검토 과정을 필수로 하는 AI 법률 보조 시스템이나, 금융 시장의 실시간 데이터를 기반으로 예측 오류를 상호 검증하는 AI 투자 분석 도구 등이 여기에 해당합니다.

결론적으로, 이 논란은 AI 기술이 보편화될수록 '신뢰성'이 단순한 기능적 특징을 넘어 핵심적인 경쟁 우위가 될 것임을 시사합니다. 스타트업은 '속도'만큼이나 '정확성'과 '책임'을 비즈니스 모델의 근간으로 삼아, 특정 니치 시장에서 '오락용'이라는 꼬리표를 떼어낼 수 있는 고신뢰 AI 솔루션을 구축하는 데 집중해야 합니다. 이는 단순히 기술 개발을 넘어 법률, 윤리, 사용자 교육 등 다각적인 접근이 필요한 복합적인 도전이자 기회가 될 것입니다.