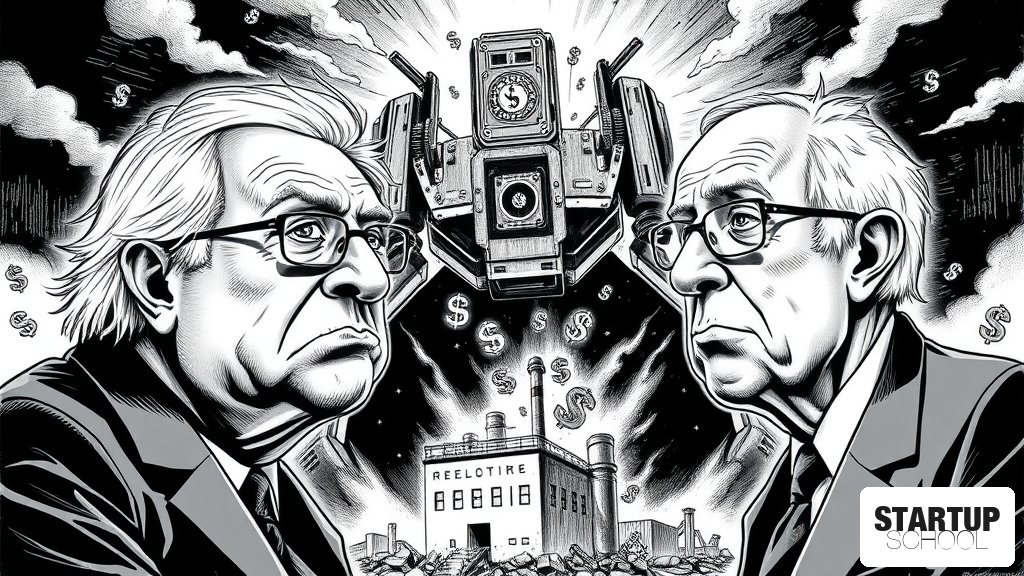

스티브 배넌과 버니 샌더스는 무엇을 공유할까? 인공지능에 대한 반대 입장

(cleantechnica.com)

정치적 극단에 위치한 스티브 배넌과 버니 샌더스가 인공지능(AI)의 위험성에 대해 공통된 우려를 표하고 있습니다. 미국 대중 또한 AI로 인한 일자리 감소와 기술의 불투명성, 그리고 수익 극대화를 위한 무분별한 시장 출시를 경계하며 AI에 대한 신뢰도가 하락하는 추세입니다.

이 글의 핵심 포인트

- 1미국인의 70%가 AI로 인한 일자리 감소를 우려함

- 2정치적 극단주의자(배넌)와 진보적 정치인(샌더스)이 AI의 위험성에 대해 공통된 입장 표명

- 3AI 개발 속도가 예상보다 빨라짐에 따라 대중의 불안감과 불신이 증폭됨

- 4수익 극대화를 위해 사용자의 심리적 취약성을 이용하는 AI 설계에 대한 비판 제기

- 5안전성 검증이 미흡한 상태에서의 급격한 시장 출시가 주요 리스크로 지목됨

이 글에 대한 공공지능 분석

왜 중요한가

AI 기술에 대한 사회적 수용성(Social License to Operate)이 위협받고 있습니다. 정치적 성향을 막론하고 일자리 상실과 책임 소재 불분명에 대한 공포가 확산되고 있다는 점은 향후 강력한 규제 도입의 강력한 동력이 될 수 있습니다.

배경과 맥락

LLM(거대언어모델) 개발에 막대한 자본이 투입되면서, 기업들이 투자 회수(ROI)를 위해 안전성 검증보다 빠른 시장 출시와 사용자 체류 시간 증대에 집중하고 있습니다. 이는 기술적 완성도보다 수익성을 우선시하는 '기술 만능주의'에 대한 대중의 반감을 키우고 있습니다.

업계 영향

AI 스타트업들은 단순한 성능 경쟁을 넘어 '책임감 있는 AI(Responsible AI)'와 '투명성'을 증명해야 하는 과제에 직면했습니다. 규제 리스크가 커짐에 따라, 기술 개발 단계부터 윤리적 가이드라인과 설명 가능한 AI(XAI)를 도입하는 것이 필수적인 생존 전략이 될 것입니다.

한국 시장 시사점

제조업과 서비스업 비중이 높은 한국은 AI로 인한 일자리 대체 공포가 미국보다 더 민감하게 작용할 수 있습니다. 따라서 한국의 AI 기업들은 기술의 효율성뿐만 아니라, 인간의 노동을 보완하고 사회적 가치를 창출하는 '인간 중심적 AI' 모델을 구축하여 사회적 합의를 이끌어내는 데 집중해야 합니다.

이 글에 대한 큐레이터 의견

스타트업 창업자들에게 현재의 상황은 '양날의 검'입니다. 기술의 급격한 확산이 가져오는 사회적 반발은 규제라는 이름의 높은 진입장벽을 만들겠지만, 역설적으로 '신뢰할 수 있는 AI'를 구축하는 기업에게는 거대한 시장 기회가 될 것입니다. 단순히 챗봇의 성능을 높이는 것에 매몰되지 말고, 사용자의 심리를 이용해 중독을 유도한다는 비판을 피할 수 있는 윤리적 설계가 필요합니다.

특히 Character.ai의 사례처럼 '문제가 해결되지 않았어도 일단 출시한다'는 전략은 단기적인 트래픽을 가져올 수 있으나, 장기적으로는 브랜드의 존립을 흔드는 치명적인 리스크가 됩니다. 창업자들은 AI의 '기능적 우위'와 '윤리적 안전성' 사이의 균형을 맞추는 'Trustworthy AI' 프레임워크를 비즈니스 모델의 핵심 요소로 내재화해야 합니다. 규제가 오기 전에 스스로 표준을 제시하는 선제적 대응이 필요합니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.